一枚要約

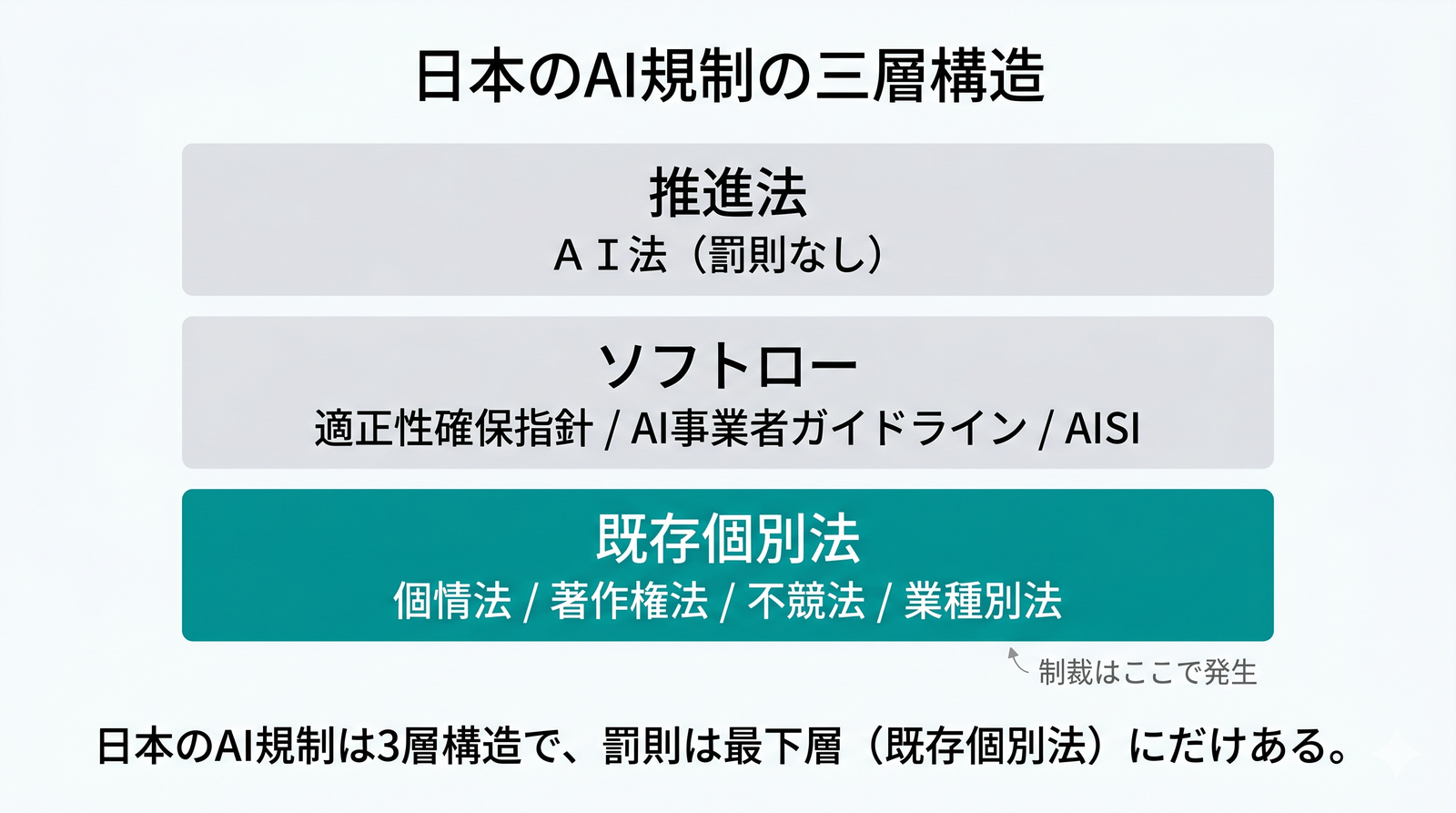

何が起きているか: 日本のAI規制は「AI法1(国会制定の枠組み法、罰則なき推進法)」「拘束力なきソフトロー群」「既存個別法(個情法・著作権法・銀行法・薬機法等)」の三層構造で成立しています。2026年3月末時点で横断文書が7本(AI法 + 6本のソフトロー)、業界別ガイドラインは金融・医療・製造・通信それぞれに存在します。

自社への影響: 業界別ガイドラインは特定の個別法(薬機法・銀行法等)の上に乗る形になっており、「AI事業者ガイドラインに準拠すれば十分」とはなりません。自社業種の法令を一次規制として、その上にソフトローが積み重なる構造の把握がポリシー設計の土台です。複数業種にまたがる場合は、最も規制が厳しい業界(医療=薬機法承認、金融=個別行政指導、通信=外部送信義務、一般事業)を一次規制の基準として採用し、他業界のソフトローを上乗せするのが原則です。

打つべき手: 三層のうちどの層が自社に直接適用されるかをマッピングし、AI事業者ガイドライン第1.2版の付属チェックリストを用いた社内AIポリシーのギャップ分析に着手します。

日本のAI規制は2025〜2026年にかけて急速に整備が進みました。2025年6月にAI法(人工知能関連技術の研究開発及び活用の推進に関する法律、令和7年法律第53号)が公布・施行され、同年12月には人工知能戦略本部が適正性確保指針を決定しました。2026年3月末にはAI事業者ガイドライン第1.2版が改訂され、総務省が「AIのセキュリティ確保のための技術的対策に係るガイドライン」を公表しました。こうした動きを横断的に整理したのが本記事のマップです。

なぜ今このマップが必要か

CISO・法務担当者から最も多く聞くのが「どのガイドラインを基準にAIポリシーを書けばいいかわからない」という声です。その理由は明確で、省庁横断で増殖したソフトローが相互参照を前提に設計されており、一本だけ読んでも全体像が見えないからです。

AI事業者ガイドラインは総務省・経済産業省が共同所管し、適正性確保指針はAI法第13条を法的根拠とする内閣府(人工知能戦略本部)の決定です。個人情報保護は個情委、著作権は文化庁、営業秘密は経産省、AIセーフティは内閣府・IPA内のAISI——と所管が分散しています。業界別には金融庁・厚労省・国交省・総務省がそれぞれ独自のガイドラインを整備しています。

「全部読む」のは現実的ではありません。重要なのは「自社が見るべき層」を特定し、優先順位をつけてポリシーに落とし込む「地図の読み方」を身につけることです。本記事では三層構造(横断レイヤー・業界別レイヤー・既存個別法)のそれぞれを解説し、CISO・経営層が意思決定できる粒度まで整理します。

横断視点なしに社内ポリシーを書くと、具体的な問題が生じます。「AI事業者ガイドラインには記載があるが個情法との整合を検討していなかった」「著作権の学習段階と利用段階でルールが異なることを知らなかった」「業種規制側(銀行法・薬機法)との矛盾がある」——こうした抜けや矛盾は、横断マップを持たない組織で繰り返し発生しています。特に複数業種にまたがるグループ企業や、医療DXに参入するIT企業にとってはリスクが高い状況です。

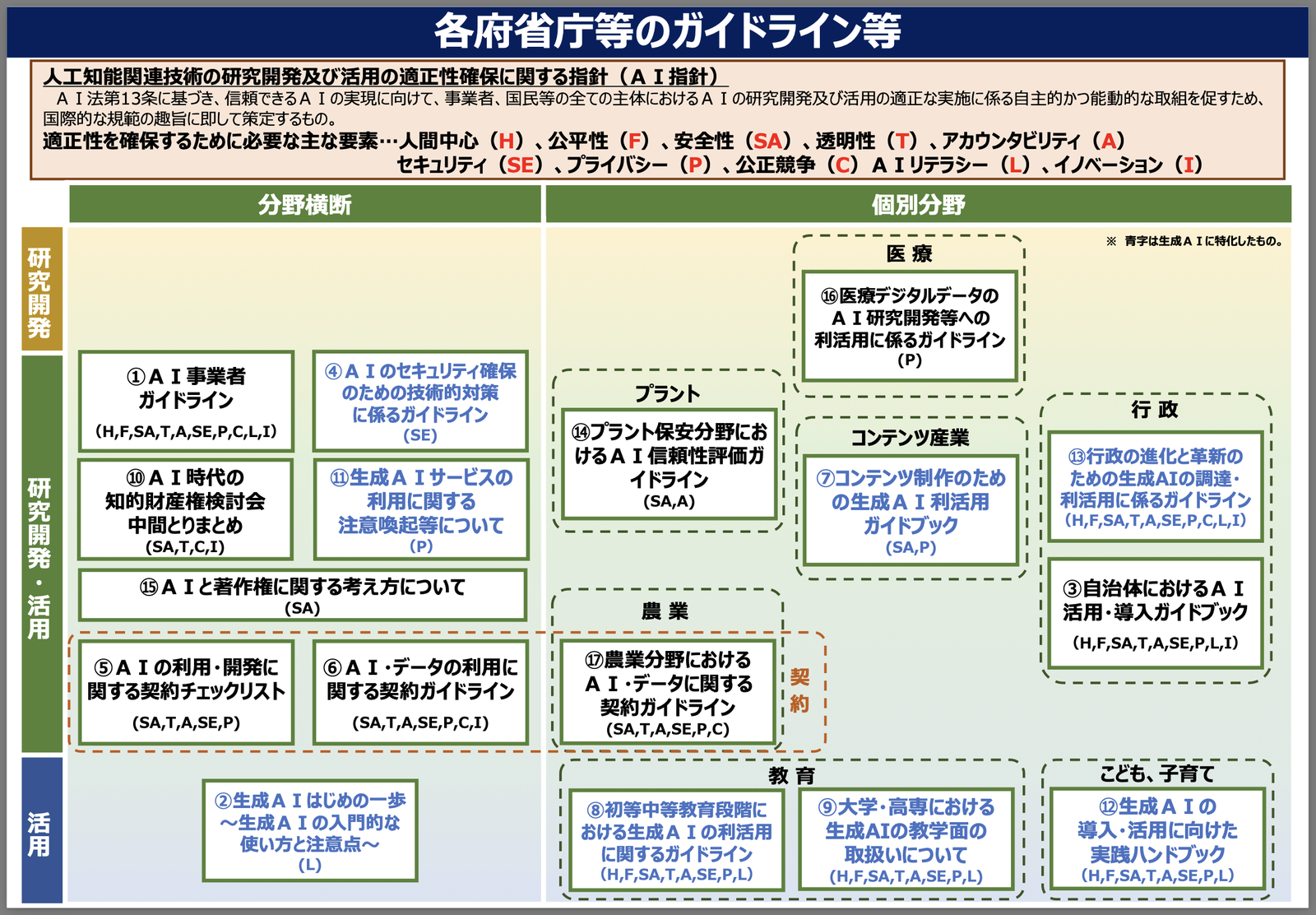

上図は内閣府が公表した「人工知能に関する各府省庁等のガイドライン等一覧」です。適正性確保指針(AI法第13条)を中心に、分野横断と個別分野のガイドラインが10要素(H,F,SA,T,A,SE,P,C,L,I)のラベル付きで整理されており、自社業種の参照先を視覚的に確認できます。

横断レイヤー:全業種が見るべき7本

横断レイヤーの全体像を一覧表で示します。罰則欄の「個別法側」は、関連個別法に違反すれば刑事罰・行政処分が発生する意味です。

| 文書 | 所管 | 性質 | 最新版・公表時期 | 罰則 |

|---|---|---|---|---|

| AI法 | 国会制定法 | 枠組み法(推進法) | 2025年9月全面施行 | なし |

| 適正性確保指針 | 人工知能戦略本部 | AI法第13条に基づく指針 | 令和7年12月19日 | なし |

| AI事業者ガイドライン | 総務省・経産省 | ソフトロー(Living Document) | 第1.2版(2026年3月31日) | なし |

| 個情委 生成AI注意喚起 | 個人情報保護委員会 | 注意喚起 | 令和5年6月2日 | 個別法側 |

| 文化庁「AIと著作権の考え方」 | 文化庁 | 解釈指針+チェックリスト | 令和6年3月15日/7月31日 | 個別法側 |

| 営業秘密管理指針 | 経済産業省 | 指針 | 最終改訂 令和7年3月31日 | 個別法側 |

| AISI ドキュメント群 | AIセーフティ・インスティテュート | 評価観点・実務マニュアル | 令和8年3月(CAIO関連他) | なし |

AI法 — 罰則なき枠組み法が何を生んだか

AI法(人工知能関連技術の研究開発及び活用の推進に関する法律、令和7年法律第53号)は2025年6月4日に公布・一部施行された、全28条の枠組み法です。法令の名称こそ「推進」ですが、その実質は「AI活用に向けた国・事業者・国民の責務を定め、個別法との連携基盤を整える」ことにあります。第三章(人工知能基本計画)と第四章(人工知能戦略本部)については附則で「公布から3か月以内に政令で定める日から施行」とされ、その政令日となる2025年9月1日に全面施行されました(AISI公式文書記載)。なお本記事では法令の正式略称である全角の「AI法」と、AI技術一般の半角「AI」を意図的に使い分けています。

最も重要なのは罰則条項がないという事実です。AI法単体では違反しても直接の制裁を受けません。罰則は個別法(個情法・著作権法・不競法等)側にあります。この点は、EU AI Actが違反時に大規模な罰金を規定する姿勢と対照的です。AI法を「違反してはならない規制」として捉えるよりも、「以後のソフトロー整備・国際整合の憲法的土台」として理解する方が実務的に正確です。

ただし日本弁護士連合会や市民社会からは「権利保護規定を欠く推進法では個人の権利救済に不十分」との批判もあり、今後の法改正議論の焦点の一つとなっています。論点の中立性のため、推進志向への賛否両論が継続していることは把握しておくべき前提です。

第7条(活用事業者の責務)は努力義務として定められており、強制力は限定的です。一方、第13条は国が「国際的な規範の趣旨に即した指針の整備その他の必要な施策を講ずるものとする」と定め、これが適正性確保指針・AI事業者ガイドラインの直接の法的根拠となっています。第3条第4項(基本理念)は「不正な目的又は不適切な方法で行われた場合には、犯罪への利用、個人情報の漏えい、著作権の侵害その他の国民生活の平穏及び国民の権利利益が害される事態を助長するおそれがあることに鑑み、その適正な実施を図るため、人工知能関連技術の研究開発及び活用の過程の透明性の確保その他の必要な施策が講じられなければならない」と既存個別法との連携を明示しており、AI固有の新規制というより「既存法の実効化と国際整合のための枠組み」という設計意図が読み取れます。

適正性確保指針 — AI法第13条直結の人工知能戦略本部決定

人工知能関連技術の研究開発及び活用の適正性確保に関する指針(適正性確保指針)は、令和7年12月19日(2025年12月19日)に人工知能戦略本部が決定した、わずか10ページながら法的根拠を持つ最上位指針です。AI事業者ガイドラインより上位に位置し、全主体(国・地方公共団体・研究開発機関・活用事業者・国民)に適用されます。

指針が示す適正性確保に必要な10要素は、人間中心(H)・公平性(F)・安全性(SA)・透明性(T)・アカウンタビリティ(A)・セキュリティ(SE)・プライバシー・個人情報(P)・公正競争(C)・AIリテラシー(L)・イノベーション(I)の10点です。AI事業者ガイドライン第1.2版の10原則とも対応しており、両文書は一体として読む設計になっています。

4つの基本方針として「リスクベースでのアプローチ」「ステークホルダーの積極的な関与」「一気通貫でのAIガバナンスの構築」「アジャイルな対応」が明示されています。事業者向けには指針第2章で特に取り組むべき事項が具体化されており、社内AIポリシーの根拠として参照できます。

注目すべき点として、指針の脚注(注20)では各府省庁におけるAI統括責任者(CAIO)の設置が要請されています。民間企業においても、AISIが発行したCAIOガイドブック(令和8年3月1日)がこれを実務的に補完します。「誰がAIガバナンスの最終責任を持つか」が問われる局面で、この指針が根拠として機能します。

AI事業者ガイドライン第1.2版 — 社内ポリシーの土台

AI事業者ガイドライン第1.2版(2026年3月31日改訂、総務省・経済産業省共同)は、AI事業者が社内AIポリシーを構築する際の実質的な土台となるドキュメントです。本編42p+別添185pに加え、チェックリスト・仮想事例・活用手引きが付属します。初版(2024年4月)は従来の3本のガイドラインを統合して生まれ、第1.2版では生成AIの実態調査を反映して改訂されています。

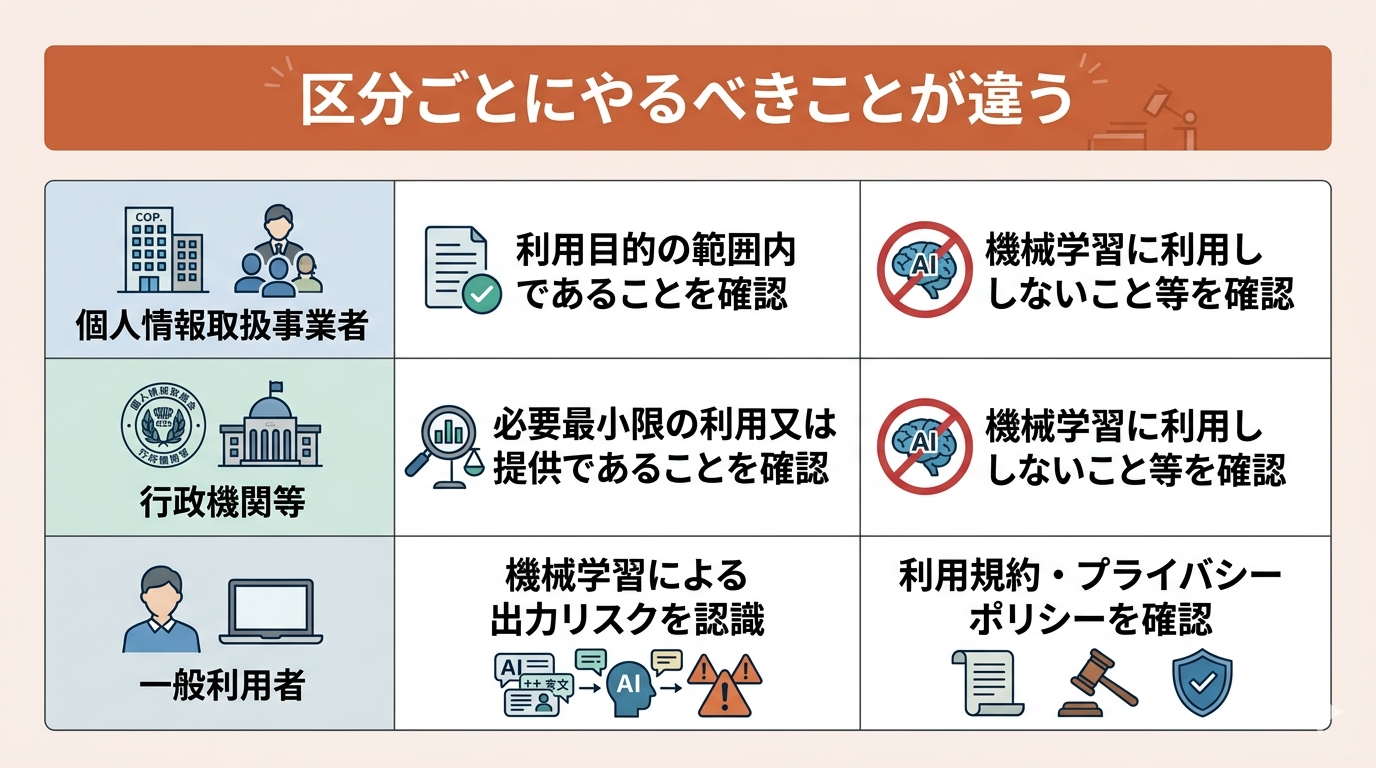

実務で最も重要な点は三区分(開発者・提供者・利用者)でやることが違うという設計です。AIを内製開発する組織は第3部(AI開発者)、自社サービスに組み込んで提供する組織は第4部(AI提供者)、社内業務に利用する組織は第5部(AI利用者)を中心に読むことになります。多くの一般事業会社は「利用者」として第5部から着手するのが現実的です。10原則の全列挙を社内ポリシーに転記するより、「自社は開発者・提供者・利用者のどれか、あるいは複数か」を確認することが先決です。

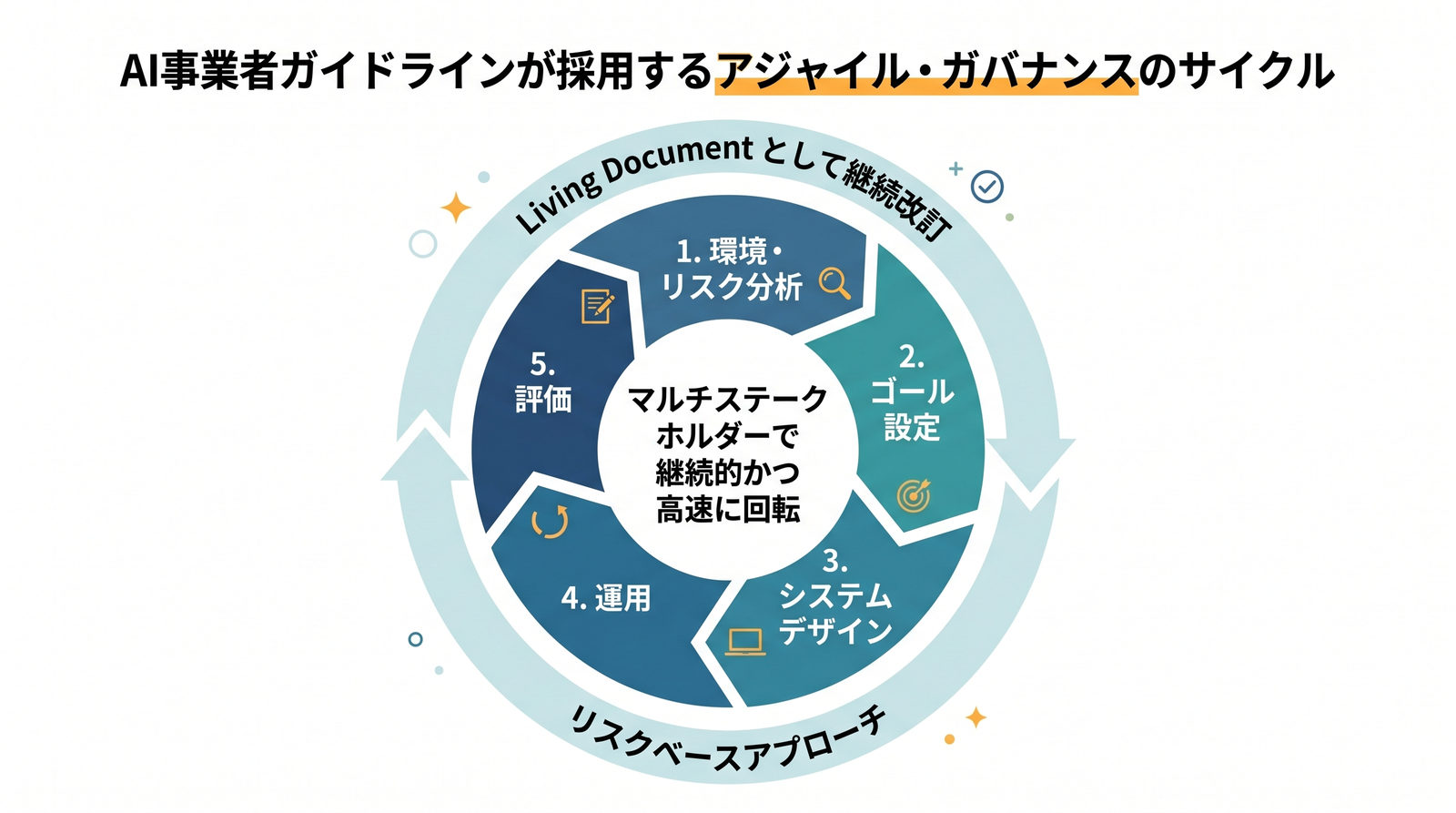

性質は非拘束的なソフトローで、リスクベースアプローチとアジャイル・ガバナンス(「環境・リスク分析」→「ゴール設定」→「システムデザイン」→「運用」→「評価」のサイクルをマルチステークホルダーで継続的に回転させる)を採用したLiving Documentです。改訂が継続される前提で運用されており、固定的なチェックリストとして「一度対応すれば完了」とはなりません。

個人情報保護法と個情委 生成AI注意喚起

個人情報保護委員会(個情委)は令和5年6月2日(2023年6月2日)、生成AIに関する注意喚起を公表しました。内容は三区分(個人情報取扱事業者・行政機関等・一般利用者)別に整理されています。

個人情報取扱事業者向けの実務上の要点は2点です。「生成AIサービスへ個人情報を入力する際、利用目的の範囲内であることを十分確認する」こと、そして「機械学習に利用しない設定になっていることを確認する」ことが求められます。適用条文は第17条(利用目的の特定)・第18条(利用目的による制限)・第27条(第三者提供の制限)等です。

注意喚起の別添2ではOpenAIへの個情法第147条に基づく注意喚起が行われており、具体的には法第20条第2項(要配慮個人情報の取得)および法第21条第1項(利用目的の通知等を日本語で行うこと)が言及されています。第147条は個情委が外国にある事業者に対しても情報提供を求められる規定で、個情委はOpenAIのサービスが日本国内に重要な影響を及ぼすと判断し本条を適用しました。これは個情委が生成AIを単なる「利用側」の問題として扱うのではなく、プラットフォーム事業者自体の遵守義務として捉えていることを示す重要な先例です。G7データ保護・プライバシー機関ラウンドテーブルも2023年6月に「生成AIに関する声明」を採択しており、国際的な監督当局の一致した方向性を示しています。

著作権法と文化庁「考え方」+チェックリスト&ガイダンス

著作権法のAI文脈における解釈は、文化審議会著作権分科会法制度小委員会が令和6年3月15日(2024年3月15日)に取りまとめた「AIと著作権に関する考え方について」(46p)が基本文書です。文化庁著作権課は令和6年7月31日(2024年7月31日)に「AIと著作権に関するチェックリスト&ガイダンス」を公表し、実務向けの整理が整いました。

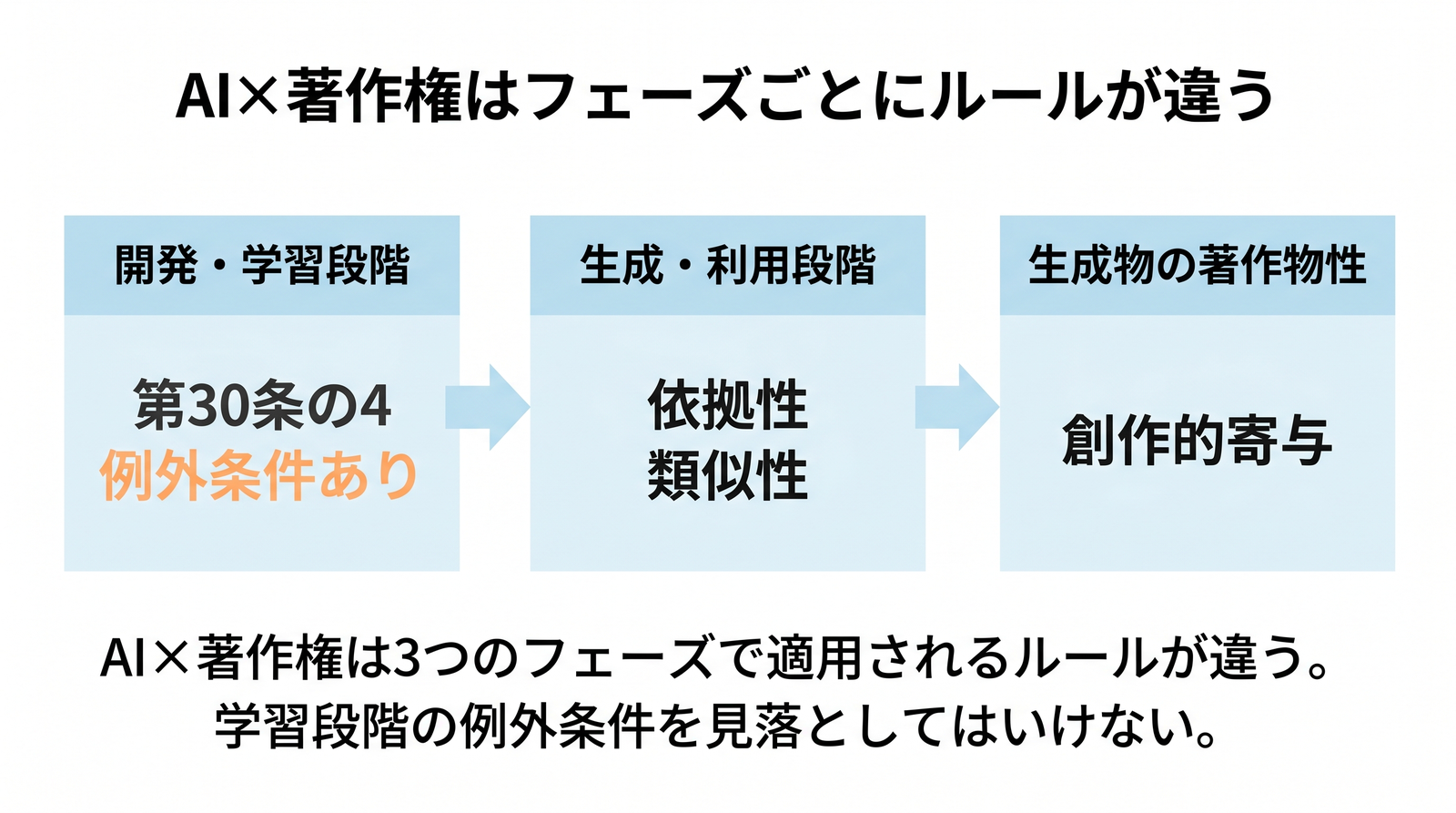

「考え方」が示す三段階整理は以下のとおりです。

- 開発・学習段階: 著作権法第30条の4(情報解析のための利用)の解釈。AI学習目的での著作物利用について権利者の許諾なく利用できる範囲を整理しています。ただし「著作権者の利益を不当に害することとなる場合」は同条の適用外となる例外条項が同時に明記されており、この除外範囲の解釈は現在も論争中です。権利者団体は適用範囲の縮小を求めて文化審議会で継続審議中であり、今後の法改正で学習段階の取扱いが変わる可能性があります。「AI学習は著作権フリー」という単純化は誤りです。

- 生成・利用段階: 依拠性・類似性の判断、軽微な利用、私的使用の適用範囲。AIが生成したコンテンツが既存著作物と類似する場合の侵害成立要件が論点です。

- 生成物の著作物性: 創作的寄与の判断。AIが出力した内容に人間の創作的寄与がある場合に著作権が発生し得ます。

法的拘束力はなく解釈指針ですが、裁判所や行政機関が参照する可能性の高い公的文書です。チェックリスト&ガイダンスは「AI開発者/AI提供者/AI利用者/業務外利用者」の4区分で実務チェックを整理しており、生成AI活用ポリシーの著作権章の根拠文書として活用できます。コンテンツ業界・メディア・ゲーム企業のCISOは、特に第30条の4の例外条件の解釈論争を継続的にウォッチしていくべき領域です。

不正競争防止法 — 営業秘密管理指針の射程

経済産業省の営業秘密管理指針(最終改訂 令和7年3月31日、2025年3月31日)は、不正競争防止法第2条第6項が定める営業秘密の三要件(秘密管理性・有用性・非公知性)の充足方法を具体的に示す文書です。平成27年(2015年)の全面改訂から、平成31年1月(2019年1月)のAI・第四次産業革命を反映した改訂を経て、今回の最終改訂(令和7年3月)ではテレワーク・派遣労働等の働き方の変化が反映されました。

AI文脈での核心的な論点は「AIの学習データ・モデルパラメータ・プロンプトが営業秘密または限定提供データとして保護され得るか」です。これらは個別に三要件の充足を判断する必要があり、特に「秘密管理性」——具体的には「秘密であることを明示し、アクセスを制限する社内体制があるか」——が問われます。

社員が生成AIサービスに会社の内部情報を入力する行為が、意図せず秘密管理性を損なうリスクも指針の射程に入ります。「生成AIへの入力禁止情報の明示化」は法務・情報システム部門が協働して整備すべきポリシー項目です。限定提供データとの関係は時系列で整理すると、平成30年改正で限定提供データ制度が導入(令和元年7月施行)され、その後令和5年改正で「限定提供データの保護対象から営業秘密を除外する」規定が追加(令和6年4月施行)されました。両者の区別自体は不競法に従来から存在する設計で、令和5年改正は重複適用を整理した位置付けです。AI学習データ・モデルパラメータの保護を検討する際は、どちらの制度で保護を求めるかの判断が必要になります。

AISI — 強制力なきが事実上の参照基準

AI Safety Institute(AISI Japan)は2024年2月にIPA内に設立され、内閣府・経産省・総務省・デジタル庁・文科省・厚労省・防衛省等との連絡会体制で運営されています。

2026年初頭時点の主要文書は、AIセーフティ ファクトシート 2025(令和8年3月31日、20p)とAIセーフティ年次レポート 2025(令和8年3月31日、21p)、そして実務への影響が最も大きいChief AI Officer 設置・AIガバナンス実務マニュアル v1.00(令和8年3月1日、78p)とChief AI Officer ガイドブック v1.00(令和8年3月1日、15p)です。

AISIの文書には法的拘束力がありません。しかし「強制力なきが事実上の参照基準」という位置付けが正確です。政府調達・行政指導での参照が進む中、民間企業においても「AISIの評価観点に照らして問題ないか」が取締役会・監査での問いになりつつあります。

CAIOガイドブックは「CAIOの役割と責任」として「AI戦略策定」「企画・開発・調達・導入監理」「ガバナンス・倫理・コンプライアンス」「組織変革・人材育成」「内部・外部連携」の5領域を定義しており、経営層向けに最も実装可能な文書といえます。セキュリティ担当者・CISOがAI専任役員(CAIO)と協働する体制設計の根拠文書として活用できる点が要点です。

業界別レイヤー:自社業界はどこを見るか

業界別レイヤーは「一次規制(個別法)+ 横断ソフトロー(AI事業者ガイドライン等)+ 業界別ガイドライン」の3層で構成されます。読者が自社業界を見つけられるよう、主軸4業界の対応関係を整理します。

| 業界 | 一次規制(個別法) | 横断ソフトロー | 業界別ガイドライン |

|---|---|---|---|

| 金融 | 銀行法/保険業法/金商法 | AI事業者ガイドライン第1.2版 | AIDP第1.1版/モデル・リスク管理に関する原則 |

| 医療 | 薬機法(医療機器プログラム) | AI事業者ガイドライン第1.2版 | 厚労省 医療デジタルデータAI研究開発ガイドライン/AISIヘルスケア領域評価観点ガイド |

| 製造・自動車 | 道路運送車両法/道路交通法 | AI事業者ガイドライン第1.2版 | 国交省 自動運転車の安全確保ガイドライン第2版 |

| 通信 | 電気通信事業法(外部送信規律) | AI事業者ガイドライン第1.2版 | 総務省 AIセキュリティ技術的対策ガイドライン/電気通信事業における個人情報等の保護に関するガイドライン |

金融

金融機関がAIを活用する際の規制構造は三重です。個別法(銀行法・保険業法・金融商品取引法)が一次規制として根底にあり、その上にAI事業者ガイドライン(横断ソフトロー)が乗り、さらに金融庁固有のAI関連ソフトローが上乗せされます。他業界と異なるのは、この上乗せ部分が特に充実している点です。

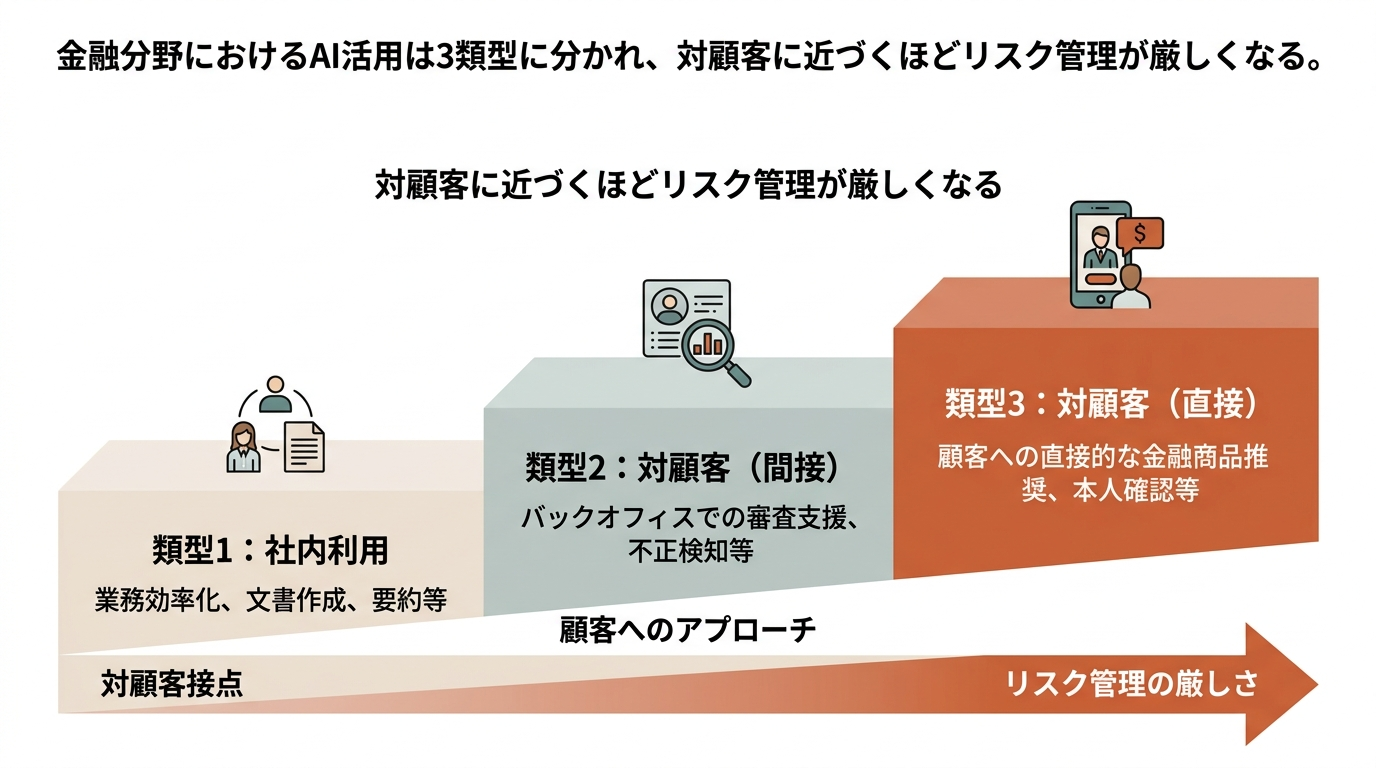

金融庁固有の文書で最も重要なのが「金融分野におけるAIの健全な利活用の促進に向けた初期的な論点整理(AIディスカッションペーパー)第1.1版」(2026年3月、55p)です。初版(2024年3月、第1.0版)から生成AIの実態調査を反映して改訂されました。AIユースケースを「社内利用」「対顧客間接」「対顧客直接」の3類型に分類しており、CISO・業務担当者が「自社のどのAI活用がどのリスク管理を要求されるか」をマッピングする起点になります。全社的体制9項目(データ整備、ガバナンス、社内ルール、人材、投資対効果、モデル・リスク管理、サードパーティ、情報セキュリティ、金融犯罪対策)と、個別AIシステム5項目(説明可能性、公平性・バイアス、ハルシネーション、個人情報保護、規制対応)の二軸構成が実務的な網羅性を担保しています。

もう一本の重要文書が「モデル・リスク管理に関する原則」(令和3年11月12日、2021年11月12日公表、15p)です。AIモデルもこの原則の対象に含まれ、「モデルの特定・インベントリー・リスク格付」「モデル開発・記述書・テスト」「モデル承認」「継続モニタリング」「モデル検証」の一連のサイクルが求められます。金融機関が独自開発またはファインチューニングしたAIモデルについては特に、このサイクルの文書化が監査・検査対応で問われます。

他業界との違いは「AIが与信・審査・本人確認といった法的規制のかかる金融行為に直結する」点です。「公平性・バイアス」「ハルシネーション」「説明可能性」が顧客の財産に直接影響することから、金融庁AIDPがこれらを専節で扱う構成となっています。金融機関のCISOは、情報セキュリティに加えて「AIモデルの公正性と説明可能性」まで管理責任が拡張されている状況です。

医療

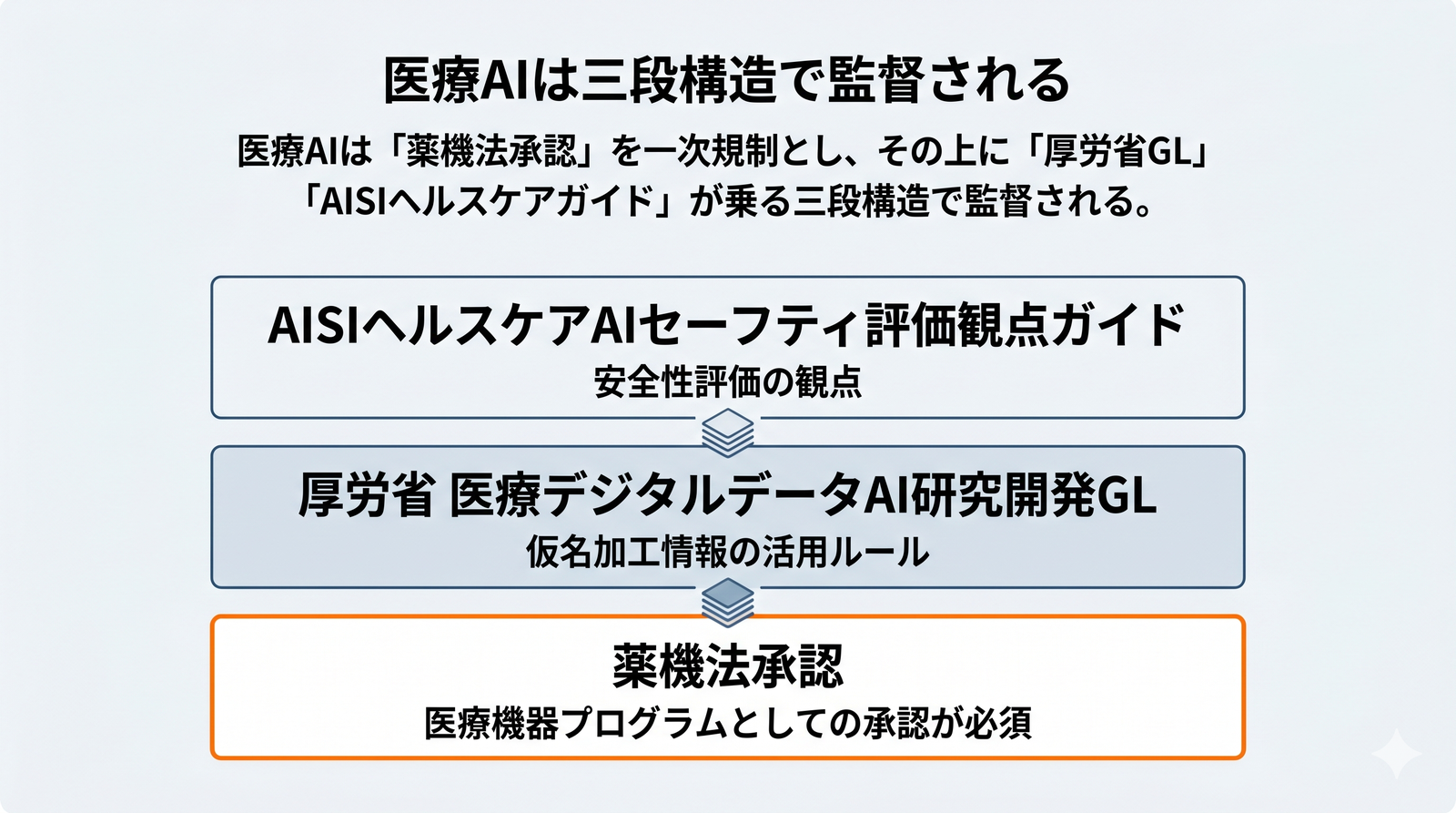

医療分野のAI規制は、薬機法(医薬品、医療機器等の品質、有効性及び安全性の確保等に関する法律)が一次規制として機能する点が他業界と決定的に異なります。AIを組み込んだ医療機器プログラム(SaMD、Software as a Medical Device)は薬機法上の「医療機器」として承認が必要であり、ソフトローの話をする前に薬機法の適用可否を判断することが必須です。

この一次規制の上に、「医療デジタルデータのAI研究開発等への利活用に係るガイドライン」(令和6年3月31日、2024年3月31日、厚労省、61p)が乗ります。厚労省は令和6年9月30日に事務連絡として周知し、同年12月19日に留意点を追加しました。法的拘束力はなく厚労科研の成果物ですが、医療機関・民間企業の共同研究でのデータ活用指針として実質的な基準となっています。

最大の論点は「製品開発目的での仮名加工情報の活用」です。学術研究例外・公衆衛生例外で対応できないシナリオ——例えば民間企業が医療機関のデータを使って診断支援AIを開発する場合——の手順を整理したのがこのガイドラインです。補助文書として「医療機器開発に仮名加工情報を共同利用する医療機関と民間企業等における体制整備ブック」(2024年3月、81p)が実務手順を詳細化しています。

さらに、AISIが令和8年4月3日(2026年4月3日)に「ヘルスケア領域 AIセーフティ評価観点ガイド v1.0」(118p)を公表しました。医療AIに特有の安全性評価観点を提示しており、薬機法の承認プロセスと相互補完の関係にあります。医療分野のCISO・情報システム部門は「薬機法承認(一次規制)」「厚労省ガイドライン(研究開発段階)」「AISIガイド(安全性評価)」の三段構造を意識しつつ、個情法の仮名加工情報の手続き要件を並走して管理する設計が求められます。

製造・自動車・モビリティ

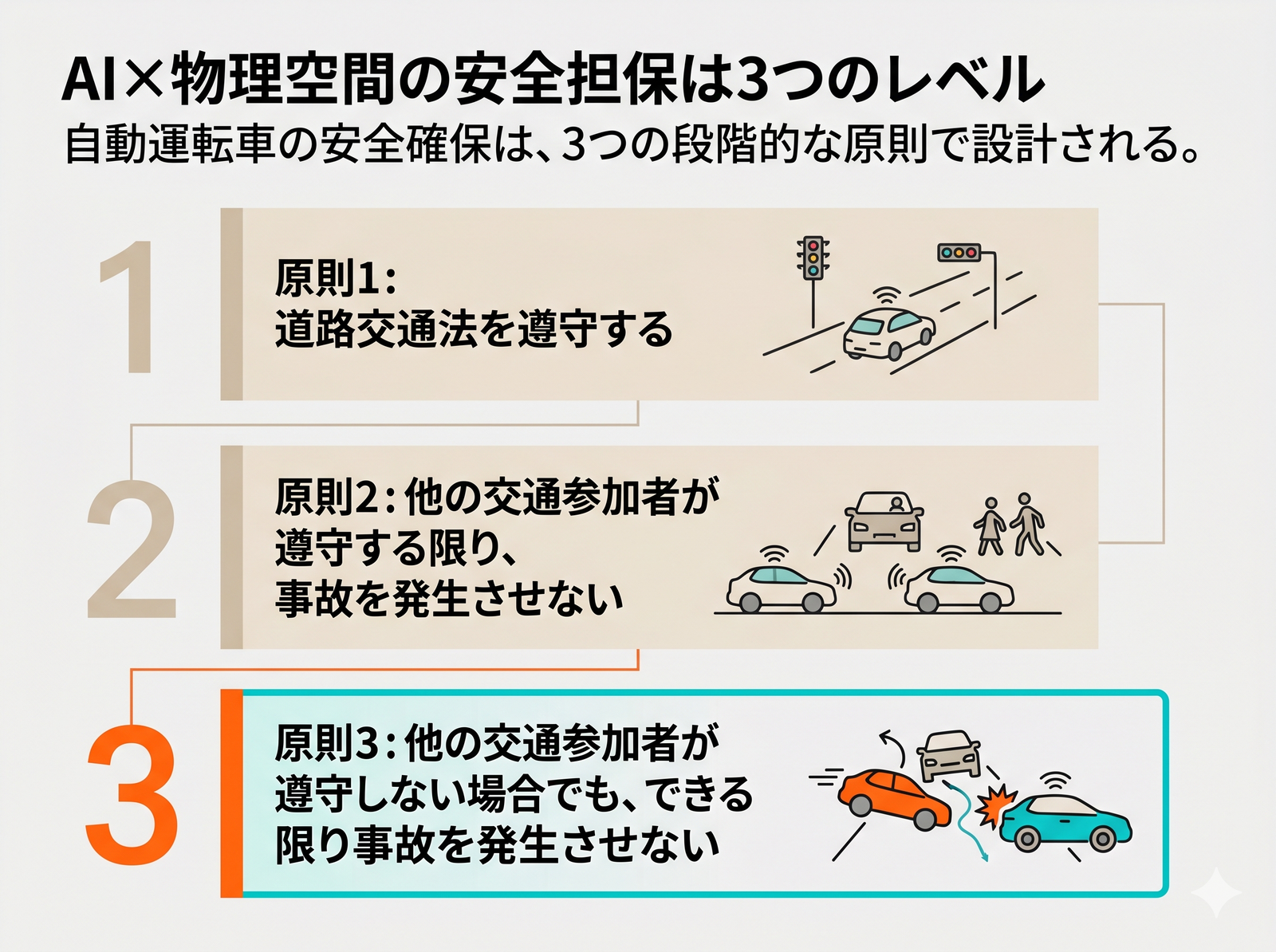

製造・自動車業界では、道路運送車両法の保安基準と道路交通法が一次規制として機能し、その上に国土交通省の行政ガイドラインが乗る構造です。業界の特性として「AIの判断が直接的に物理空間に作用し、即座に人命に影響する」点が他業界と最も異なります。

「自動運転車の安全確保に関するガイドライン 第2版」(令和7年9月30日、2025年9月30日、国交省物流・自動車局、11p)は、人又は物の運送サービスを行うレベル4自動運転車を対象としています。基本的考え方として3原則を定めており、「①自動運転車は道路交通法を遵守する」「②他の交通参加者が遵守する限り事故を発生させない」「③他の交通参加者が遵守しない場合でもできる限り事故を発生させない」が骨格です。AIの振る舞いを法的基準に落とし込んだ数少ない実例として、他業界の参照にも値します。

他業界と決定的に異なる論点が「走行環境条件(ODD、Operational Design Domain)との関係」です。自動運転AIが「どこで・どんな条件で動く設計になっているか」が安全確保の核心であり、医療AIや金融AIと異なり設計段階での条件設定が許認可に直結します。第2版ではWP.29規則第157号(自動車線維持機能、レベル3)等との整合が明記されており、国際的な型式認証プロセスとリンクした安全確保の枠組みを採用している点が要点です。自動車メーカー・Tier1サプライヤーの情報セキュリティ担当者は、自動運転システムのサイバーセキュリティ要求(UN-R155等の国際規則)とこのガイドラインの両面から対応を設計しなければなりません。

通信

通信業界は、AI事業者ガイドラインの所管省庁(総務省)が業界監督省庁でもあるという特異な立場にあります。この構造上、ソフトローが最も充実しており、技術的対策レベルまで具体化されている点が他業界との大きな違いです。

総務省は令和8年3月(2026年3月)、「AIのセキュリティ確保のための技術的対策に係るガイドライン」(本編25p+別添20p)を公表しました。対象は主にLLM(大規模言語モデル)を構成要素に含むAIシステムのAI開発者・AI提供者です。AIセキュリティの技術的脅威としてプロンプトインジェクション攻撃・DoS攻撃を明示し、開発者・提供者それぞれの対策と「サービス想定事例別の分析」を提示しています。AI事業者ガイドラインの「セキュリティ確保」原則を技術対策レベルで具体化した文書として、通信業界以外のAI開発者・提供者も参照すべき内容です。

個別法側では電気通信事業法第27条の12(外部送信規律)が通信業界のAIサービスをトリガーします。AIサービスが「電気通信役務」に該当する場合、サービス提供者はユーザーへの外部送信の説明・通知義務を負います。総務省が公表した「電気通信事業法 外部送信規律 FAQ」(22p)が実務判断の参考となります。

また、「電気通信事業における個人情報等の保護に関するガイドライン」は令和7年9月26日(2025年9月26日)に個情委・総務省告示第2号として最終改正され、令和8年4月更新の解説(289p)が付属しています。通信業界の情報システム担当者は、一般的な個情法対応に加えてこのガイドラインの遵守が求められます。AI関連のソフトローが最も厚い領域として、CISOが優先的に把握しておくべき領域です。

その他分野は政府公式の俯瞰図に委ねる

公共調達(「行政の進化と革新のための生成AIの調達・利活用に係るガイドライン」令和7年5月27日 デジタル社会推進会議幹事会決定)、教育(文科省の生成AIガイドライン群)、コンテンツ産業(経産省)、プラント保安(消防庁・厚労省・経産省)、農業(農水省)、こども・子育て(こども家庭庁)など、本記事でカバーしきれない分野については内閣府が公表する俯瞰図(前掲)を参照してください。適正性確保指針を頂点に、それぞれの分野番号付きで参照先が視覚的に整理されています。

日本式アプローチの特徴:EU・米国との比較

日本のAI規制の最大の特徴は「三層構造+罰則は個別法側」という設計思想です。AI法・適正性確保指針・AI事業者ガイドラインには罰則がなく、ソフトローと既存個別法の組み合わせで実効性を担保する方式をとっています。

| 法体系 | 罰則 | 適用範囲 | 改訂頻度 | |

|---|---|---|---|---|

| EU | EU AI Act(ハードロー) | 大規模罰金 | 全EU加盟国直接適用+域外適用 | 段階施行中 |

| 米国 | 連邦法不在+州法乱立 | 州ごと | 州内(一部域外波及) | 流動的 |

| 日本 | 三層構造(枠組み法+ソフトロー+個別法) | 個別法側のみ | 国内+国際整合 | Living Document(継続改訂) |

EU AI Actとの比較では、リスクベースアプローチという基本方針は共通しています。しかし日本は「ハイリスクAI」という強制分類と罰則を持ちません。EU AI Actは違反時に大規模な罰金と全EU加盟国への直接適用を伴うハードローです。日本式は「自主的遵守+既存法の執行」を基軸としており、国際展開する企業はEUのハードローとの二重準拠が別途必要です。具体的には、EUの市場向けにAIシステムを提供・展開する日本企業にはEU AI Actが域外適用されます。同法は段階施行で、禁止AI(ソーシャルスコアリング等)は2025年から、ハイリスクAIや汎用AI関連の義務は2026〜2027年にかけて段階的に本格適用されます。医療診断支援・与信等のAnnex III記載のハイリスク区分に該当する企業は、適用区分とタイムラインを欧州委員会の最新公表で個別確認する必要があります。EU子会社・拠点経由での間接適用も見落としやすい論点として認識しておく価値があります。

米国との比較では、バイデン政権が2023年10月に発した大統領令(EO 14110)が、トランプ政権により2025年1月20日の就任初日の大統領令で即日撤回され、連邦レベルの包括的AI法は不在の状況です。州法ではコロラドAI法(SB 205)が採用・与信等の重要決定でのAI利用規制として2024年に成立しましたが、施行時期の修正・業界からの反発・修正法案の動きが断続しており、最新の施行状況は本稿執筆時点で流動的です。日本より法的予測可能性が低い側面があります。日本式は「連邦法不在+州法乱立」の米国型より体系的な整合性は高く、「包括規制+罰則」のEU型よりは企業の裁量が大きいという中間的位置付けです。

補足(ソフトロー違反の民事責任リスク): ソフトロー違反に直接の制裁はありません。しかしAI起因の損害が発生した場合、裁判所や行政機関は「事故当時の関連ガイドラインを参照したか」を不法行為上の注意義務充足の事情として考慮しうるため、ソフトロー準拠・非準拠の記録は民事責任の局面で意味を持ちます。逆に「存在を知りながら参照しなかった」事実が示されれば、過失認定の加重要因になるリスクがあります。CISO・法務が「ソフトローは任意だから」とのみ経営層に説明することは適切ではありません。実効性の証明を求める海外投資家・パートナーからの照会も増えており、行政指導・業界団体による自主規制・調達要件といった間接的エンフォースメントの蓄積もこれから進みます。

アジャイル・ガバナンスとLiving Documentの方針は、AI技術の急速な変化に対応する設計として評価できます。一方で「企業がいつでも追加対応を求められる不確実性」と表裏一体でもあります。国際整合の面では広島AIプロセス(G7)、ISO/IEC 42001、WP.29等を参照しており、グローバル標準との整合が図られています。複数国に展開する日本企業は、EU/米国の規制に加えてこれらの国際標準への対応を並走させることが避けられません。

今日着手できる3アクション

セキュリティ・ガバナンス担当者が当日中に着手できる具体タスクを3つ示します。

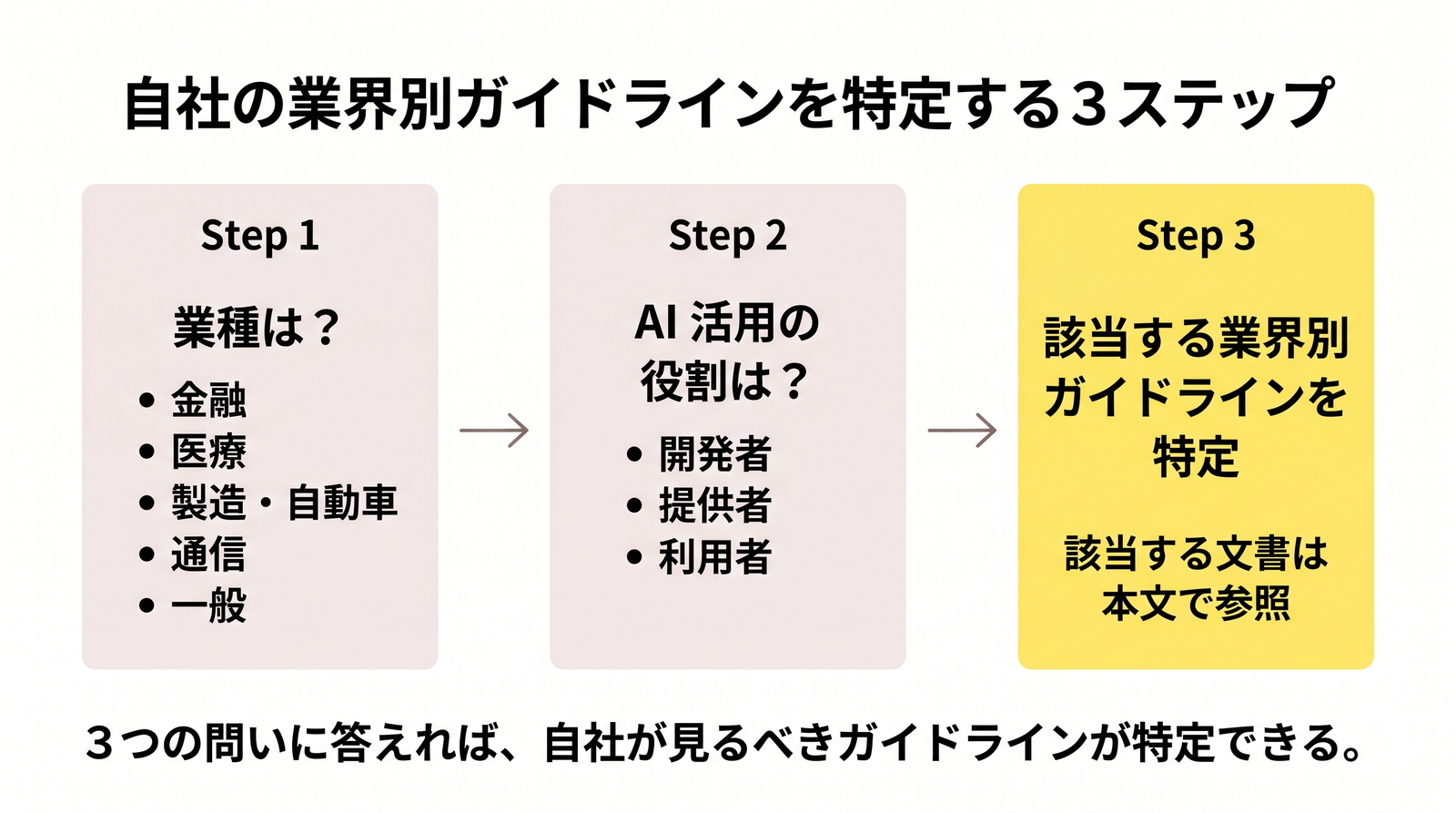

- 三層マッピングの社内可視化: 自社に適用される三層を1ページにまとめます。最初に①業種確認(金融/医療/自動車/通信/一般)→②AI活用形態確認(開発者/提供者/利用者)→③該当する業界別ガイドラインの特定の3ステップで自己診断します。次に「個別法(銀行法/薬機法/道路運送車両法等)」「横断ソフトロー(AI事業者ガイドライン第1.2版/適正性確保指針)」「業界別ガイドライン(金融庁AIDP/厚労省ガイドライン/国交省ガイドライン/総務省AIセキュリティガイドライン)」を一覧化し、法務・情シス・経営企画が共有できる文書とします。AI事業者ガイドライン第1.2版および各府省庁等のガイドライン等一覧は内閣府の AI指針ハブページからまとめて辿れます。

- 社内AI利用ポリシーの著作権・個情法・営業秘密の三点チェック: 既存の社内AIポリシーに対して、①個情委令和5年6月注意喚起(機械学習利用禁止設定の確認・要配慮個人情報の入力禁止)、②文化庁チェックリスト&ガイダンス(学習段階と利用段階でルールが異なる点の確認、第30条の4の例外条件の認識)、③営業秘密管理指針(入力禁止情報の明示化・秘密管理性の維持)の三点でギャップを確認します。この三点は業種を問わず全事業者に共通します。

- CAIO役割の仮設計と経営層への提案: AISIが公表した「Chief AI Officer ガイドブック v1.00」(令和8年3月1日、IPAサイト掲載)を確認し、自社でのAI管理責任者の役割範囲(AI戦略策定・ガバナンス・コンプライアンス・他のCxOとの連携)をCISO主導で文書化し、経営企画・法務と共有します。役員レベルでの設置が難しい場合でも、「誰がAIの適正利用に責任を持つか」を組織図に明記するだけで、監査・インシデント対応の起点が整います。適正性確保指針の脚注20でも各府省庁におけるCAIO設置が要請されており、民間でも参照可能な公的根拠として活用できます。

AI×セキュリティの観点

日本のAI規制マップは「ガバナンス・コンプライアンス」の話として整理されがちですが、セキュリティの観点では二つの重要な変化が同時進行しています。

一つ目は攻撃面での変化です。総務省の「AIのセキュリティ確保のための技術的対策に係るガイドライン」が明示するように、LLMを含むAIシステムにはプロンプトインジェクション攻撃という従来型のセキュリティ対策では検出しにくい脅威が加わりました。プロンプト経由で意図しない動作を引き起こし機密情報を漏洩させる攻撃は、既存のWAF・EDRでは対応が難しい性質を持ちます。AI導入を積極的に進める組織ほど、この新しい攻撃面へのセキュリティ評価が欠かせません。

二つ目は防御側の役割拡張です。AISIのCAIOガイドブックが定義する「ガバナンス・倫理・コンプライアンス」の役割は、CISOの職掌と重複・隣接します。AIリスク管理にセキュリティ評価・個情法対応・著作権管理・営業秘密管理が含まれることで、従来「情報セキュリティ」の枠外だった法務・倫理リスクがCISOの視野に入ります。規制マップの整備は単なるコンプライアンス作業ではなく、AIシステムの攻撃面拡大に対応したセキュリティ体制の再設計そのものといえます。

用語ミニ解説

- AI法 — 「人工知能関連技術の研究開発及び活用の推進に関する法律」(令和7年法律第53号)の略称。罰則規定を持たない推進法・枠組み法で、2025年6月4日に公布・施行された。以後のソフトローの法的根拠(第13条)を提供する土台となっている。 ↩

- ソフトロー — 法律(ハードロー)のように法的強制力を持たないが、行政・業界団体・市場参加者が事実上従うことを期待するガイドライン・行動規範・原則の総称。違反しても直接の法的制裁は発生しないが、行政指導・調達要件・投資家評価に影響しうる。

- AISI — AI Safety Institute(AIセーフティ・インスティテュート)の略。2024年2月にIPA内に設立された機関で、AIの安全性評価・実務マニュアル整備を担う。強制力はないが政府調達・行政指導で参照される事実上の基準機関。

- CAIO — Chief AI Officer の略。AI戦略策定・AI導入監理・AIガバナンス・コンプライアンスを統括する役員または責任者。AISIが令和8年3月1日に設置・運営マニュアルを公表し、各府省庁においても適正性確保指針(注20)で設置が要請されている。

- モデル・リスク管理 — 金融機関が使用するAI・統計モデルの誤謬・誤用から生じるリスクを識別・測定・管理する体制。金融庁が令和3年11月12日に「モデル・リスク管理に関する原則」を公表しており、金融機関の独自開発AIモデルも対象となっている。

- 限定提供データ — 不正競争防止法第2条第7項が定める保護対象。電磁的に管理され、特定の者に対して業として提供される情報(データベース等)を指す。営業秘密と異なり非公知性の要件がない代わりに、令和5年改正により営業秘密に該当するものは本制度の対象から除外された。AI学習用に契約ベースで配布されるデータセットの保護が主な活用場面となる。

- AI事業者ガイドライン — 総務省・経済産業省が共同で公表する、AI開発者・提供者・利用者向けの非拘束的なソフトロー。最新版は第1.2版(2026年3月31日改訂)。10原則とアジャイル・ガバナンスを採用したLiving Documentで、社内AIポリシーの実質的な土台として機能する。

- 適正性確保指針 — 「人工知能関連技術の研究開発及び活用の適正性確保に関する指針」の通称。令和7年12月19日に人工知能戦略本部が決定。AI法第13条に法的根拠を持ち、AI事業者ガイドラインの上位に位置する全主体向けの最上位指針。

参考リンク

- 内閣府 人工知能関連技術の研究開発及び活用の適正性確保に関する指針(各府省庁等のガイドライン等一覧へのハブ)

- 内閣府 ホームページ利用規約

- e-Gov 法令検索 人工知能関連技術の研究開発及び活用の推進に関する法律

- 経済産業省 AI事業者ガイドライン検討会

- 総務省 AIネットワーク社会推進会議

- 個人情報保護委員会

- 文化庁 AIと著作権

- 経済産業省 営業秘密・限定提供データ

- IPA AIセーフティ・インスティテュート(AISI)

- 金融庁 AIディスカッションペーパー(金融分野におけるAIの健全な利活用の促進に向けた初期的な論点整理)

- 金融庁 モデル・リスク管理に関する原則

- 厚生労働省 医療デジタルデータのAI研究開発等への利活用に係るガイドライン

- 国土交通省 自動運転車の安全確保に関するガイドライン

コメント