本稿はシリーズ「生成AI業務利用の組み立て方」全3回の第2回です。第1回(NIST AI RMF と AI事業者ガイドラインで生成AI業務利用の枠組みを理解する)で公的フレームワークの骨格を整理しました。本稿では、すでに公開されている他社の生成AI事故から3つの構造的落とし穴を抽出します。第3回では試行から成熟運用までの段階的ロードマップを扱います。

なぜ「他社事例」から学ぶのか

生成AI業務利用に関する「失敗事例」が公開情報として出始めたのは2023年以降です。母集団がまだ少ない一方、いずれも大企業が公式コメントや報道を通じて事案を認めており、学べる情報の質は高い段階にあります。共通するのは、個別の技術ミスより組織設計上の落とし穴が原因になっているという点です。本稿では公開情報が比較的整っている3社の事案を取り上げ、その背後にある構造的問題を読み解きます。

事例1:Samsung — 機密情報のプロンプト経由流出

Samsung(半導体・電子機器、韓国)では、2023年4月に同社の半導体部門のエンジニアが ChatGPT に社内コードや会議議事録を入力した事案が報じられました。同社はこれを受けて同年5月に全従業員の業務利用を一時禁止する方針を発表し、その後は社内専用の生成AIシステム開発へ方針転換したと報じられています。本事案の根拠は各種報道(Bloomberg・Forbes・Reuters 等)に基づきます。Samsung の公式コメントは下記リンク先など。

何が起きたか: 業務効率化を目的に従業員が個人判断で ChatGPT を利用し、社内秘の半導体製造関連コードや内部会議の議事録をプロンプトに入力したとされます。当時の OpenAI のデフォルト設定ではユーザー入力がモデル改善に利用される可能性があり、管理外移転リスク(社外への意図しないデータ流出と同等のリスク)が発生しました。

構造的落とし穴 = 利用ガイドラインの不在と「個人判断展開」: Samsung のような大企業でも、生成AI登場直後の段階では全社的な利用ガイドラインが整備されていなかったため、報道では複数件の独立した入力事案が短期間に発生したとされています。組織としてため、従業員は「禁止されていないから使ってよい」と判断しました。シリーズ Part 1 で扱った AI事業者ガイドライン項目4(プライバシー保護)・6(透明性)が組織内で未整備だったことが、現場の個人判断による拡散を許しました。

この落とし穴を埋める設計: 生成AIツールの利用前に「入力してよいデータ分類」「許可ツールの限定列挙」「違反時の報告フロー」の3点を最低限のポリシーとして整備し、全従業員に周知することが必要です。完成度を求めて公開を遅らせるより、ドラフト段階でも先に展開する方が「個人判断による拡散」を抑えられます。

事例2:JPMorgan Chase — 業務利用の事前制限と「許可ツール提供」アプローチ

JPMorgan Chase(米大手金融)は2023年初頭、従業員による ChatGPT の業務利用を制限する方針を社内通達したと複数の報道で伝えられています。背景にあるのは金融機関特有のデータ規制(SEC・FINRA など)および GLBA Safeguards Rule1(顧客金融情報保護義務)で、許可なく外部生成AIサービスに業務データを入力することは規制違反のリスクを伴うという判断です。

その後、JPMorgan は報道で LLM Suite と呼ばれる社内専用の生成AIツールを開発・展開し、従業員には「禁止する代わりに、安全な代替を提供する」アプローチを取ったことが報じられています。

何が起きたか(教訓視点): 単純な禁止だけでは従業員のシャドー利用(IT・セキュリティ部門の承認外で利用するケース)を止められない、という現実的判断が背景にあります。JPMorgan の対応は禁止と提供を組み合わせた「統制された活用」モデルとして、金融以外の業種でも参照されています。

構造的落とし穴 = 「禁止だけ」では現場が回らない: 生成AIの業務効率は実証済みで、利用を禁止しても従業員はスマートフォン経由など迂回路を使います。シリーズ Part 1 の AI事業者ガイドライン項目10(イノベーション)と項目4・5(プライバシー・セキュリティ)の両立が問われる場面です。

この落とし穴を埋める設計: 「禁止 → 提供」への転換が現実的な解です。具体的には、ChatGPT Enterprise2・Microsoft 365 Copilot3・Google Workspace 向け Gemini などの企業契約版を整備し、データが学習に使われない契約条件と SSO/MFA を組み込んだ環境を提供します。社内専用 LLM の自社開発は大企業向けの選択肢ですが、まず企業契約版の調達と SSO 連携を最初の一手とするのが多くの組織で現実的です。

事例3:Amazon — 機密入力の禁止指示と社内コーディング AI 提供

Amazon(米大手 EC・クラウド)は2023年1月、従業員に対し ChatGPT に社内コードや機密情報を入力しないよう指示したと報じられました。背景には Amazon 自身が大規模なクラウド・LLM 提供事業者であることもあり、競合サービスへの自社情報流出リスクと、出力物が他社事例と類似する著作権リスクの両面が論点とされました。

その後、同社は社内エンジニア向けに Amazon Q Developer(旧 CodeWhisperer)を提供し、社内コードと外部 LLM の境界線を引くアプローチを採っています。

何が起きたか(教訓視点): Amazon の事例で注目されるのは、機密漏洩と並んで「生成物の著作権リスク(学習段階の利用は2018年改正著作権法第30条の4で原則許容される一方、生成・出力段階は通常の著作権法が適用される)」を理由として明示した点です。シリーズ Part 1 で扱った著作権リスク(依拠性・類似性4、文化庁 2024年3月文書「AIと著作権に関する考え方について」)は、Amazon が早期に問題提起した論点でもあります。

構造的落とし穴 = 「機密漏洩」だけ見ていると著作権論点を見落とす: 生成AI業務利用のリスク評価では「機密情報の流出」が最初に話題になりますが、生成物が外部流通することを前提とすると、出力された文章や画像が他者著作物に類似してしまうリスクは、機密漏洩とは別軸で評価が必要です。

この落とし穴を埋める設計: 出力物のうち「外部公開されるもの」(顧客向け資料・広報文・ウェブコンテンツ等)について、人間レビューと類似性チェックのフローを業務手順書に明記する必要があります。Part 1 で扱った「出力判断軸」の具体化として、社内文書(外部公開なし)と顧客向け文書(外部公開あり)でレビュー要件を分けるのが実務的です。

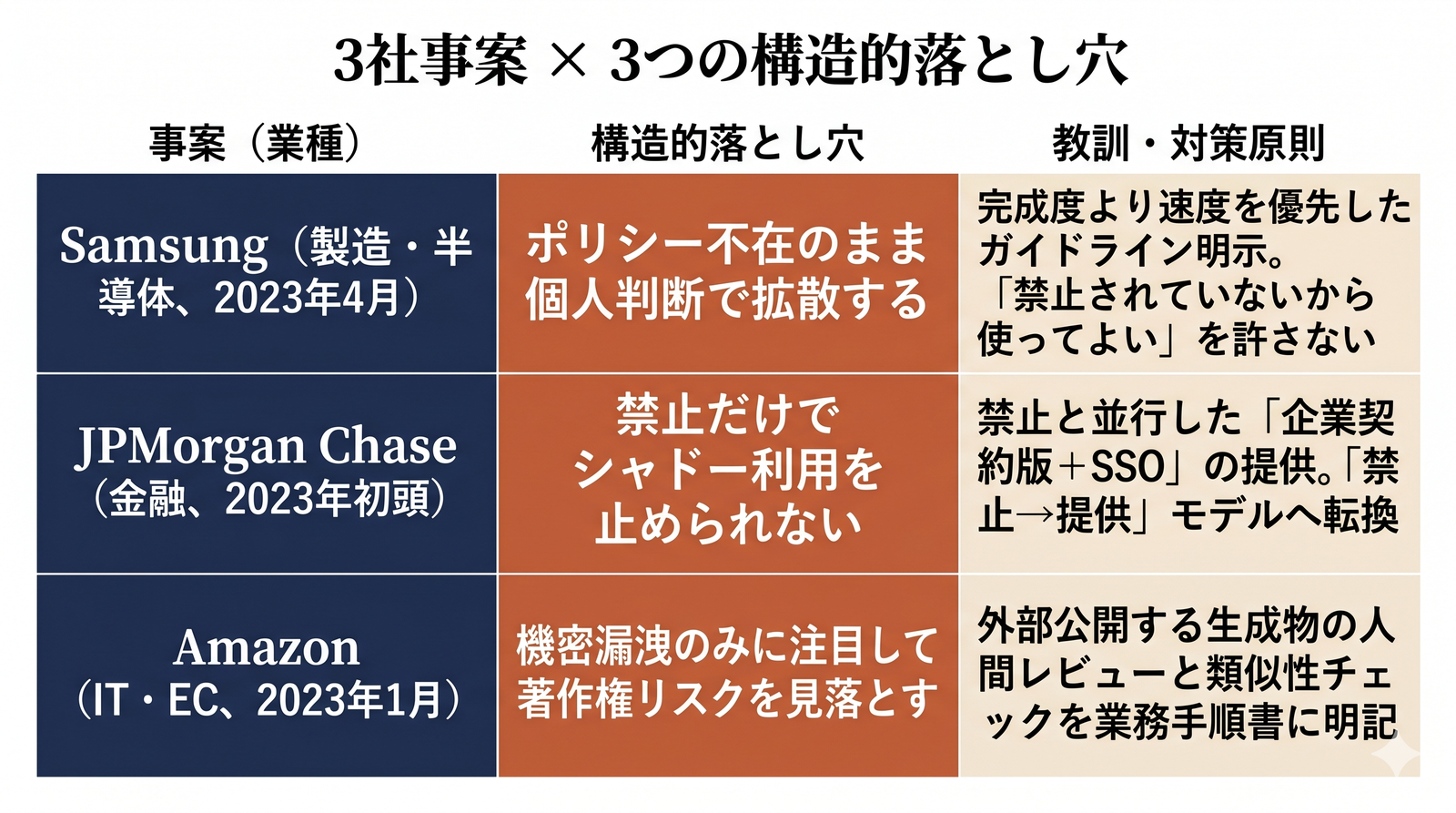

3つの構造的落とし穴の整理

3事案を横断して見えてくる構造的落とし穴を整理します。

- 落とし穴1:ポリシー不在のまま個人判断で拡散する(Samsung 型)— 「禁止されていないから使ってよい」という現場判断を許す状態。AI事業者ガイドライン項目6(透明性)が組織内で未整備な状況。

- 落とし穴2:禁止だけでシャドー利用を止められない(JPMorgan 型)— 業務効率を求める従業員はスマートフォン経由など迂回路を使う。「禁止 → 提供」への転換が必要。

- 落とし穴3:機密漏洩のみに注目して著作権リスクを見落とす(Amazon 型)— 出力物が外部流通する前提では、依拠性・類似性が機密漏洩と別軸で評価されるべき。

これらに共通する根本要因は、生成AI登場直後に既存のセキュリティポリシー・データガバナンス体系が追いついていないことです。シリーズ Part 1 で扱った NIST AI RMF と AI事業者ガイドラインを骨格に据える理由は、こうした「組織体系の追いつかなさ」を補完するためでもあります。

業種別の落とし穴の現れ方

- 金融: JPMorgan 型の「禁止だけでは回らない」が顕著。SEC・FINRA・金融庁(FSA)・FISC5 といった金融規制との整合が必要なため、外部 SaaS の利用制限が他業種より厳しい一方、業務効率化の競争圧力も強い。「企業契約版+SSO」の整備優先度が高い。

- 製造: Samsung 型の「機密情報流出」と Amazon 型の「著作権リスク」が同時に問題となる。設計図面・特許未公開情報の入力禁止と、生成物の社外流通時の類似性チェックを両方整備する必要があります。

- テクノロジー・SaaS: Amazon と同様、自社が AI 提供事業者である場合の競合情報流出リスクと、顧客向けプロダクトに生成物を組み込む際の著作権リスクの両方が論点。SOC 2 Type II6 等の監査対応で、AI 利用のガバナンス開示が問われる場面が増えています。

実装事例:先行3社の共通アプローチ

以下は公開情報からの紹介です。各社の文脈・前提が異なるため、推奨ではなく参照点として整理しています。

- Samsung(製造・半導体): 一時禁止 → 社内専用 LLM 開発への移行。「禁止 → 提供」モデルの極端な実装例として、自社開発が現実的な大規模組織向けの参照点となります。本事案の根拠は各種報道(Bloomberg・Forbes・Reuters 等)に基づきます。Samsung の公式コメントは下記リンク先など。

- JPMorgan Chase(金融): 利用制限 → 社内 LLM Suite 提供。規制業種における「禁止 + 安全な代替」モデルの代表例として、金融以外の業種でも参照されることが増えています。本事案の根拠は各種報道(Reuters・Bloomberg 等)に基づきます。JPMorgan の公式情報は下記リンクから。

- Amazon(IT・EC): 入力禁止指示 → Amazon Q Developer 等の社内コーディング AI 提供。自社が AI 提供事業者である場合の利用統制モデルとして、SaaS 事業者の参照点となります。出典

3社の共通アプローチを整理すると、①早期のガイドライン明示 ②禁止だけで終わらせない ③安全な代替の提供の3点が浮かび上がります。シリーズ Part 3 では、この3点を時系列の段階的計画に落とし込みます。

一枚要約

- 何が起きているか: Samsung・JPMorgan・Amazon の事案からは、個別の技術ミスより組織設計上の落とし穴が浮かび上がります。ポリシー不在・禁止だけの統制・著作権リスク見落としの3つが共通して問題となっています。

- 自社への影響: 生成AI登場直後の段階で既存のセキュリティポリシーが追いついていない組織では、Samsung 型の機密流出が真っ先に発生するリスクがあります。禁止だけで対応すると JPMorgan 型のシャドー利用に直面します。

- 打つべき手: ①利用前のガイドライン明示 ②禁止と並行した「企業契約版+SSO」の提供 ③外部流通する生成物の類似性チェック、の3点をセットで整備することが現実的な第一歩となります。

今日着手できる3アクション

- 「自社のシャドー AI7 利用実態」を SWG8 ログで概算する: 社内のプロキシ・SWG ログで

chatgpt.com・claude.ai・gemini.google.com・copilot.microsoft.com等のドメインへのアクセス件数を直近 1 か月分集計します。Samsung・JPMorgan の事例で起きた「個人判断による拡散」が自社で進行中かを定量把握できます。詳細はシャドーAI検出と統制設計を参照してください。 - 「禁止対象 + 代替提供ツール」をリストで対応付ける: 自社で禁止する外部 AI ツールと、それに対応する企業契約版(ChatGPT Enterprise・Microsoft 365 Copilot・Google Workspace 向け Gemini 等)を一覧表で整理します。「禁止だけで終わらない」運用への第一歩となります。

- 外部公開する生成物のレビューフローを業務手順書に追記する: 顧客向け資料・広報文・ウェブコンテンツに生成AI出力を含める場合、人間レビュー必須化と「他者著作物との類似性チェック」を業務手順書に追記します。具体的には Copyleaks・iThenticate 等の商用ツールによる文章類似検出、または生成プロンプトと出力の記録保管(依拠性の証跡管理)を組み込みます。文化庁の「AI と著作権に関する考え方について」(2024年3月)を参照資料として併記します。

リスクの周辺領域(集団訴訟・サプライチェーン波及)

3社の事例は直接的な機密漏えいや規制違反の他にも、周辺リスクの連鎖を示しています。Samsung の事案後には半導体業界全体で同種の警戒が広がり、サプライヤー契約に AI 利用条項が追加される動きが進みました。米国上場の日本企業では、生成AI 経由のインシデント開示遅延が SEC 制裁だけでなく証券集団訴訟(数百億円規模の和解事例あり)の根拠にもなります。直接事案の整理だけでなく、サプライチェーン上の取引先への波及と訴訟リスクの規模感まで含めて評価することが、CISO・法務の責任範囲となります。

AI×セキュリティの観点

3社の事例に共通する教訓は、生成AI利用の問題は「セキュリティだけの問題」ではないという点です。Samsung は機密情報、JPMorgan は規制対応、Amazon は著作権という異なる軸で問題提起されました。CISO・情シスがリスクを把握しようとするとき、セキュリティチーム単独では論点を取りこぼします。法務・知財・コンプライアンス・人事を含む横断チームで論点を整理する体制が、生成AI登場以前のサイバーリスク対応より一段階複雑な要求として浮かび上がっています。攻撃者側も AI を使ってフィッシングメールの自動生成や認証情報の高速試行を進めており、防御側の組織横断対応が攻撃側の自動化に対応する前提条件になりつつあります。

用語ミニ解説

- GLBA Safeguards Rule — 米国 Gramm-Leach-Bliley Act の安全管理規則。金融機関に顧客金融情報の保護を義務づけ、外部 AI サービスへの顧客データ送信制限の根拠の一つとなる。 ↩

- ChatGPT Enterprise — OpenAI が提供する企業向け契約プラン。SOC 2 Type II 準拠、データの学習利用なし、SSO・SCIM 対応などが標準で含まれる。 ↩

- Microsoft 365 Copilot — Microsoft 365 上の Word・Excel・Teams 等に統合された生成AI機能。テナント内データがモデル学習に使われない設計。 ↩

- 依拠性・類似性 — 生成AI出力物の著作権侵害判断の二要件。元著作物への「依拠」と表現の「類似」が両方認められる場合に侵害とされる。文化庁 2024年3月「AIと著作権に関する考え方について」で論点整理が進められた。 ↩

- FISC — 金融情報システムセンター。日本の金融機関向けセキュリティ基準(FISC 安全対策基準)を策定する業界団体で、生成AI 関連記述も逐次更新されている。 ↩

- SOC 2 Type II — 米国公認会計士協会(AICPA)が定めるクラウドサービス向けセキュリティ監査報告書の規格。Type IIは一定期間にわたる運用実態を評価するため、AIプロバイダーの信頼性確認に用いられる。 ↩

- シャドー AI(Shadow AI) — IT・セキュリティ部門の承認・把握なしに従業員が業務利用している生成AIツールやAIサービス。シャドーIT の AI 版で、機密漏洩・規制違反・ライセンス違反のリスクを伴う。 ↩

- SWG(Secure Web Gateway) — 企業の全インターネット通信を中継し、フィルタリング・ログ取得を行うセキュリティ装置。Zscaler・Netskope 等が代表製品で、シャドー AI 利用の検出に活用される。 ↩

次に読むべきトピック

- 本シリーズ Part 1 「NIST AI RMF と AI事業者ガイドラインで生成AI業務利用の枠組みを理解する」 — 公的フレームワークの構造と5判断軸

- 本シリーズ Part 3 「試行から成熟運用まで生成AI業務導入を4フェーズで段階的に計画する」(近日公開予定)

- 関連記事: シャドーAI検出と統制設計 — Samsung 型の「個人判断拡散」を検出・統制する具体手段

参考リンク

- Samsung Newsroom

- JPMorgan Chase

- Amazon Q Developer

- 文化庁(AIと著作権に関する考え方の公開元)

- 経済産業省

- 個人情報保護委員会

コメント