本稿はシリーズ「生成AI業務利用の組み立て方」全3回の第1回です。社内に生成AIを取り込もうとしたとき、最初に立ちはだかるのは「何から考えればよいか分からない」という枠組み不在の問題です。チェックリストを自作する前に、すでに公開されている公的フレームワークの構造を理解する方が遠回りに見えて近道になります。第2回は他社事故から構造的な落とし穴を読み解き、第3回は段階的な導入ロードマップを扱います。

なぜ枠組みから入るのか

生成AI業務利用の検討で最も多い失敗は、自社で独自のチェックリストを作って終わることです。15項目程度のチェックリストは作りやすい反面、根拠が薄く、組織変更や規制改定があった瞬間に陳腐化します。既存の公的フレームワークを骨格にすえ、自社の事情を肉付けするほうが長持ちし、外部監査にも説明できる構造になります。

本稿で軸にするのは次の2つです。

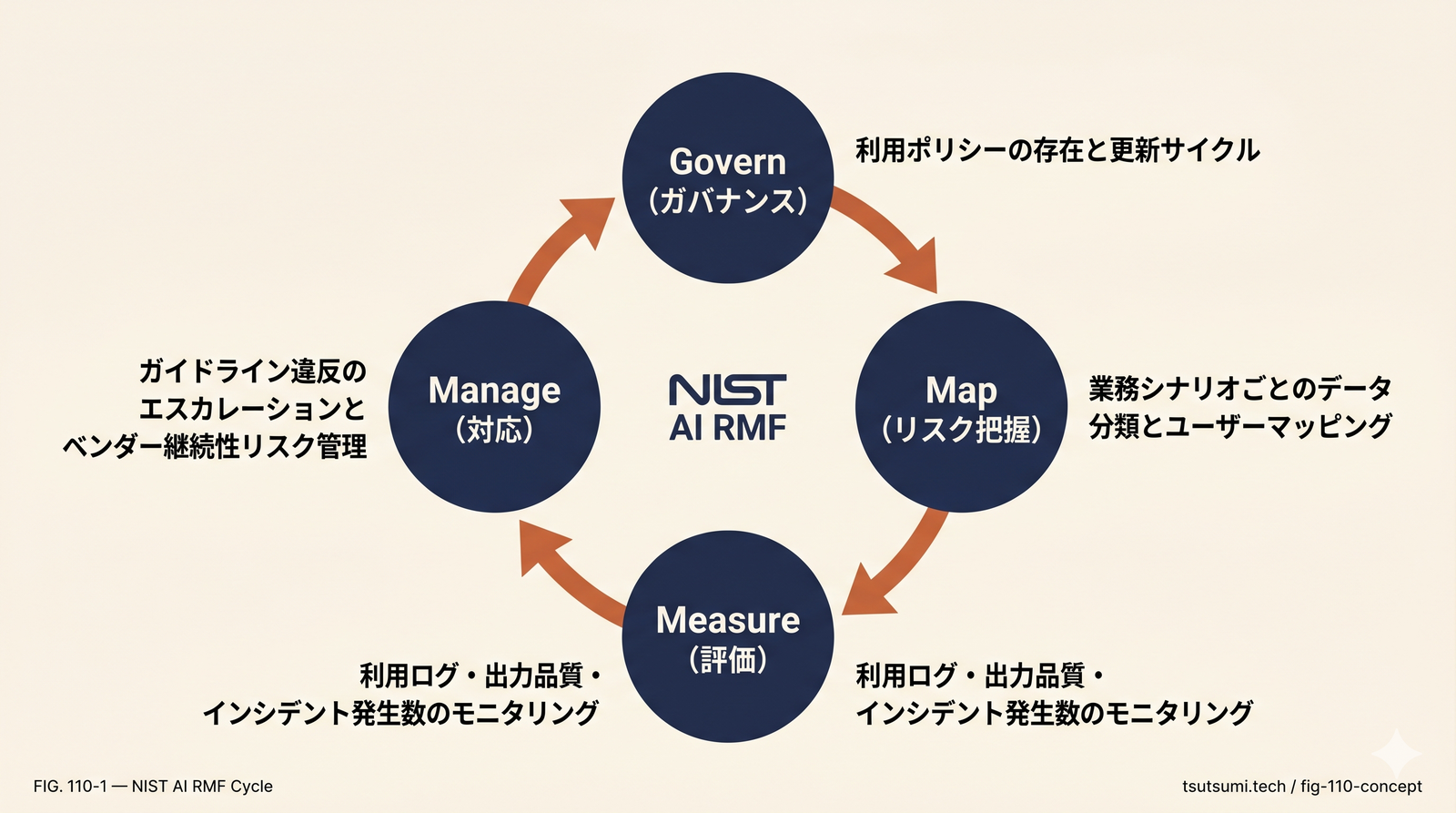

- NIST AI RMF1(AI Risk Management Framework)— 米国国立標準技術研究所が2023年1月に公開した、AIリスク管理の汎用フレームワーク。Govern(ガバナンス)/ Map(リスク把握)/ Measure(評価)/ Manage(対応)の4機能で構成され、業界横断で参照されています。

- AI事業者ガイドライン2(経済産業省・総務省)— 2024年4月に第1.0版が公開された、日本国内のAI開発者・提供者・利用者向け指針。内閣府AI戦略会議の議論を踏まえて両省が編集したもので、「AI利用者」の責務として10項目が示されています。

なお両者ともに法的拘束力を持たない任意ガイドラインである点は重要です。違反しても直ちに法令違反となるわけではありませんが、外部監査・契約交渉・株主への説明で「準拠していない」と回答することは事実上難しくなっています。事業者の自主的取り組みを促す位置づけのため、法令(個人情報保護法・著作権法等)への対応とは別レイヤーで設計する必要があります。

NIST AI RMF を業務利用視点で読み解く

NIST AI RMF はAIシステムを「設計・開発・展開・運用」のライフサイクル全体で扱う枠組みですが、AI 利用者の立場では特に Govern と Map に注力するのが現実的です。

- Govern(ガバナンス): 組織が AI リスクをどう統治するかの基盤。経営層の関与・役割分担・ポリシー文書化が含まれます。利用者視点では「生成AIツール利用ポリシーが社内文書として存在し、定期的に更新されているか」が出発点となります。

- Map(リスク把握): 利用する AI システムのコンテキスト(用途・データ・ステークホルダー)を整理する機能。利用者は「自社の業務シナリオごとに、どのAIサービスを、どのデータ分類で、誰が使うか」をマッピングする責務を負います。

- Measure(評価): AI システムのリスクを定量的・定性的に測定する機能。利用者にとっては、利用ログ・出力品質・インシデント発生数の継続モニタリングが該当します。

- Manage(対応): 検出されたリスクへの優先順位付けと対応。利用ガイドラインの違反が見つかった場合のエスカレーションフローだけでなく、AIベンダーのサービス継続性リスク管理(仕様変更・サービス終了・価格高騰への代替計画、API依存度の制限)も含まれます。BCP の重要構成要素です。

NIST AI RMF は補完文書として NIST AI 600-1(生成AI特化のプロファイル、2024年7月公開)も提供しており、生成AI固有のリスクとして「機密情報のプロンプト経由流出」「ハルシネーション」「プロンプトインジェクション」「著作権・知的財産権の侵害リスク」を Map・Measure 機能の具体検討項目として扱っています。

AI事業者ガイドラインの「AI利用者」項目を読み解く

経産省・総務省のガイドラインは AI を「開発者」「提供者」「利用者」の3者に分けて整理し、「AI利用者」が留意すべき項目として10点を示しています(簡潔に整理)。

1. 人間中心: AI 出力を最終判断の代替にしない、人間による確認プロセスを設計する。

2. 安全性: 誤動作・想定外動作への対策と影響範囲の最小化。

3. 公平性: 偏ったデータや出力の検出と是正。

4. プライバシー保護: 個人情報の入力管理と越境移転制限。

5. セキュリティ確保: アクセス制御・認証・ログ取得。

6. 透明性: 利用範囲・ルール・データ取り扱いの社内公開。

7. アカウンタビリティ: 責任所在の明確化と問い合わせ対応。

8. 教育・リテラシー: 従業員への研修と継続的な学習。

9. 公正競争確保: 不正利用や独占的振る舞いの抑制。

10. イノベーション: 適切な範囲での積極活用。

このうち業務利用前に最優先で押さえるべきは、4・5・1・6(プライバシー、セキュリティ、人間中心、透明性)です。公平性(3)や公正競争(9)は AI システム自体の設計者側の性質が強く、利用者側では「ベンダー選定時に確認する論点」として扱うのが現実的です。

著作権リスクの取り扱い(独立論点)

生成AI業務利用で見落とされがちなのが著作権リスクです。日本では2018年改正著作権法第30条の4により、AI学習段階での著作物利用は原則として著作権侵害にならないとされていますが、生成・出力段階は通常の著作権法が適用されます。具体的には次の3点が論点です。

- 入力リスク: 他者の著作物(文書・画像)をプロンプトに入力する場合、ベンダーのモデル学習に転用されるリスクと、著作権者の許諾を得ていない複製にあたる可能性。

- 出力リスク: 生成された文章・画像が既存の著作物に類似してしまうリスク(依拠性・類似性が認められる場合)。

- 権利帰属の不明確さ: 生成物の著作権が誰に帰属するかは現在も論点で、自社の業務成果物として安全に利用できる範囲を社内ルール化することが望まれます。

文化庁が2024年3月に「AIと著作権に関する考え方について」を公表しており、業務利用ルール策定時の参照資料となります。

二つの枠組みを重ねて見える「業務利用前の5つの判断軸」

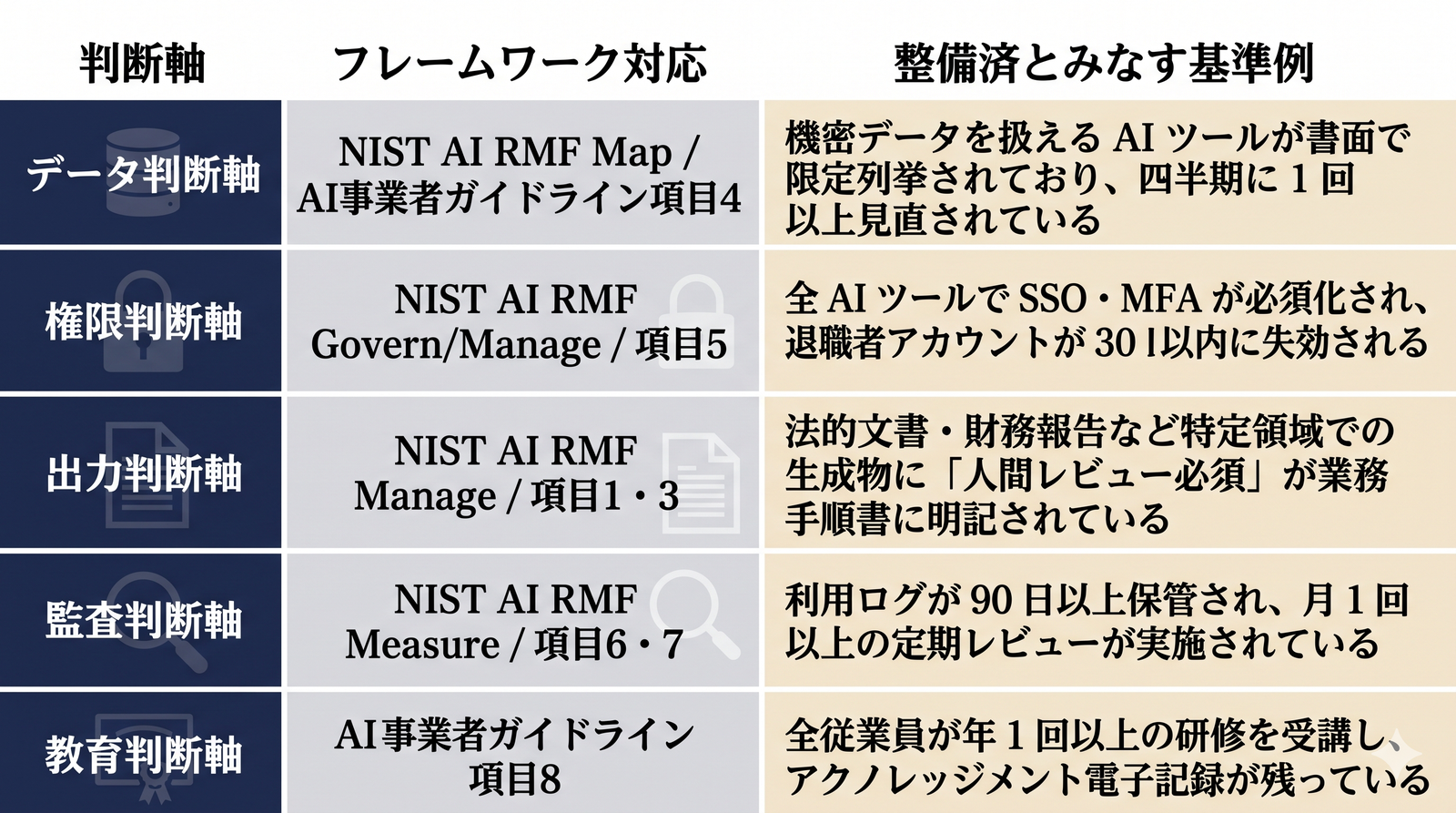

NIST AI RMF と AI事業者ガイドラインを重ねると、業務利用前に整理すべき5つの判断軸が浮かび上がります。各軸に最低1つの「整備済」とみなす基準例を添えます。

- 1. データ判断軸: 入力データの分類(公開/社内限/機密)と、それぞれに使えるツール・プランの対応関係を文書化しているか。整備済の基準例: 機密データを扱える AI ツールが書面で限定列挙されており、四半期に1回以上見直されている。NIST AI RMF Map、AI事業者ガイドライン項目4。

- 2. 権限判断軸: 誰が・どのツールで・どの範囲のデータにアクセスできるかを SSO/RBAC で制御しているか。整備済の基準例: 全 AI ツールで SSO・MFA が必須化され、退職者アカウントが30日以内に失効される運用が回っている。NIST AI RMF Govern/Manage、項目5。

- 3. 出力判断軸: ハルシネーション・偏り・機密漏えいの可能性を踏まえ、ハイリスク用途で人間によるレビューを必須化しているか。整備済の基準例: 法的文書・財務報告など特定領域での生成物に「人間レビュー必須」が業務手順書に明記されている。NIST AI RMF Manage、項目1・3。

- 4. 監査判断軸: 利用ログの取得・保管・レビュー体制が整っているか。整備済の基準例: 利用ログが90日以上保管され、月1回以上の定期レビューが実施されている。大規模組織では SIEM への集約が理想ですが、中小規模では Excel/Spreadsheet へのログ定期エクスポート+月次レビューから始めても十分機能します。NIST AI RMF Measure、項目6・7。

- 5. 教育判断軸: 全従業員が「何が許容で、何が禁止か」を理解しているか。整備済の基準例: 全従業員が年1回以上の研修を受講し、アクノレッジメントの電子記録が残っている。AI事業者ガイドライン項目8。

5軸は独立しているように見えて、実務上は順序が重要です。「データ→権限→出力→監査→教育」の順で整備すると、後段の議論が前段の決定に依存して進むため、手戻りが少なくなります。

公的フレームワークの限界と補完

両フレームワークを骨格にすることの利点は前述の通りですが、限界も認識しておく必要があります。NIST AI RMF は中小企業には抽象的すぎて適用が難しく、KPI が定められていないため成熟度評価が恣意的になりやすいという批判があります。AI事業者ガイドラインは前述の通り任意指針で、法的拘束力を欠くため悪質事業者を排除できない点も指摘されています。

これらの限界を埋めるには、業種固有の認証制度・基準との組み合わせが有効です。

- 公共・自治体: ISMAP3(情報システムのためのセキュリティ評価制度)登録サービスの優先採用が政府機関・自治体の調達基準に組み込まれています。AI サービス調達では ISMAP 登録の有無確認が、監査ログ整備よりも先行して行うべきチェックです。

- 金融機関: FISC 安全対策基準(金融情報システムセンター)にAI システム関連記述があり、金融庁の監督指針と併せて参照することが求められます。NIST AI RMF だけを根拠にすると不十分です。

- 個人データ取扱い全般: 改正個人情報保護法(2024年改正案を含む議論が進行中)を踏まえ、特に AI を経由した個人データの第三者提供・越境移転の整理が求められます。

業種別影響

- 金融: 顧客取引データ・与信情報を扱うため、データ判断軸で「公開情報のみ」を最も狭く設定する必要があります。FISC 安全対策基準と金融庁監督指針の両方との整合が前提条件です。

- 製造: 設計図面・特許未公開情報の扱いが論点。出力判断軸でハルシネーションが製品仕様の誤伝達に直結するリスクがあるため、人間レビュー必須範囲を広めに取る判断が現実的です。著作権リスクも、設計補助に使う場合は特に注意が必要です。

- 公共・自治体: 住民情報・行政文書の取り扱いで、ISMAP 登録サービス優先が調達コンプライアンス上の最初の関門となります。情報公開請求への対応を視野に入れ、監査判断軸の保管期間を長めに設定する必要があります。

EU AI Act の域外適用

EU AI Act(2024年成立)は域外適用規定(第2条)を持ち、EUの利用者向けに AI システムを提供・展開する日本企業には直接適用される可能性があります。EU 市場に子会社・取引先を持つ日本企業も間接的な影響を受けます。NIST AI RMF への準拠は EU AI Act との整合性確保の一助になりますが、対応内容が一致するわけではないため個別確認が必要です。シリーズ Part 3 の段階的ロードマップでは、グローバル展開企業向けの規制マッピングも扱う予定です。

実装事例:主要ベンダー・機関の対応状況

以下は公開情報からの紹介です。各社の文脈・前提が異なるため、推奨ではなく参照点として整理しています。

- Microsoft(テクノロジー): Microsoft 365 Copilot のデータ取り扱いを Trust Center で公開し、テナント内データがモデル学習に使われないことを明示しています。NIST AI RMF Govern 機能の「透明性」を実装した事例として参照されます。出典

- OpenAI(AIプロバイダー): Enterprise 向けに Trust Portal で SOC 2 Type II4 レポートとデータ処理契約(DPA5)を公開し、利用者側の「データ判断軸」と「監査判断軸」を支える基盤を提供しています。出典

- 経済産業省(公的機関): AI事業者ガイドライン本体と関連資料を公開しており、自社の社内規程を組み立てる際の一次資料として参照できます。出典

一枚要約

- 何が起きているか: 生成AI業務利用の検討で「自作チェックリスト」止まりになる組織が多く、根拠の薄さと陳腐化リスクが課題となっています。NIST AI RMF と AI事業者ガイドラインを骨格にすえる方が長持ちしますが、両者とも任意ガイドラインであり法令対応・業種固有基準との併用が前提となります。

- 自社への影響: 枠組み不在のまま展開すると、外部監査・規制改定・経営報告のたびに手戻りが発生します。著作権リスク・EU AI Act 域外適用・業種固有基準(ISMAP・FISC)まで視野に入れた設計が求められます。

- 打つべき手: 「データ・権限・出力・監査・教育」の5判断軸で社内ポリシーを整理し、各軸を NIST AI RMF と AI事業者ガイドラインの該当機能・項目に紐づけて文書化することが現実的な第一歩となります。

今日着手できる3アクション

- NIST AI RMF と AI事業者ガイドラインの原典 PDF を入手する: それぞれ NIST AI RMF 公式ページ と 経済産業省 からダウンロードします。社内勉強会の資料として配布し、まず読まれている状態を作ります。

- 5判断軸(データ・権限・出力・監査・教育)の社内現状を A4 一枚で診断する: 各軸を「整備済/部分的/未整備」の3段階で記入します。本稿で示した判断基準例(ログ90日以上+月1レビュー、SSO/MFA 必須化+30日以内失効 等)を社内基準のたたき台として活用してください。未整備の軸から着手順を決めます。

- 生成AI利用ポリシーの草案を1ページで作成する: AI事業者ガイドラインの項目1・4・5・6を骨格に、自社で利用許可するツールと禁止データ分類を1ページにまとめます。著作権リスク(他者著作物の入力禁止・出力物の利用範囲)も明記します。完成を待たずにドラフト段階で法務・人事と共有することで、認識合わせと優先度の共有が始まります。

AI×セキュリティの観点

公的フレームワークを軸に据えるアプローチは、AI 規制の急速な進展に対する保険にもなります。EU AI Act が2024年に成立し、米国でも州レベルで AI 規制が乱立し始めている現状で、自社チェックリストを毎回作り直すのは現実的ではありません。NIST AI RMF や AI事業者ガイドラインのような国際的に参照される枠組みに準拠していれば、新規制への対応コストが構造的に下がります。攻撃者側も AI を使った攻撃手法を高度化しており、防御側の枠組み準拠は単なるコンプライアンス対応ではなく、侵害発生時の説明責任を果たすための基盤になります。

用語ミニ解説

- NIST AI RMF(AI Risk Management Framework) — 米国国立標準技術研究所が2023年1月に公開したAIリスク管理の汎用フレームワーク。Govern・Map・Measure・Manage の4機能で構成され、業界横断で参照されている。生成AI特化の補完文書 NIST AI 600-1 が2024年7月に公開された。 ↩

- AI事業者ガイドライン — 経済産業省・総務省が2024年4月に公開した第1.0版。内閣府AI戦略会議の議論を踏まえ、AI開発者・提供者・利用者の3者に分けて整理し、利用者には10項目の留意点が示されている。法的拘束力はない任意指針。 ↩

- ISMAP(情報システムのためのセキュリティ評価制度) — 政府機関・自治体がクラウドサービスを調達する際に参照する登録制度。AI サービス調達でも登録の有無が調達基準として確認される。 ↩

- SOC 2 Type II — 米国公認会計士協会(AICPA)が定めるクラウドサービス向けセキュリティ監査報告書の規格。Type IIは一定期間にわたる運用実態を評価するため、AIプロバイダーの信頼性確認に用いられる。 ↩

- DPA(Data Processing Agreement) — データ処理契約。クラウドサービス提供者が顧客データをどのように処理・保管・削除するかを取り決めた契約。 ↩

次に読むべきトピック

- 本シリーズ Part 2 「Samsung・JPMorgan・Amazon の生成AI事故から構造的落とし穴を読み解く」 — 失敗事例から3つの構造的落とし穴を抽出

- 本シリーズ Part 3 「試行から成熟運用まで生成AI業務導入を4フェーズで段階的に計画する」 — 試行から成熟運用までの段階的ロードマップ

- 関連記事: シャドーAI検出と統制設計 — 承認外の生成AI利用への対応設計

- 関連記事: AI規制の日米欧比較 — EU AI Act・NIST AI RMF・AI事業者ガイドラインの規制側比較

参考リンク

- NIST AI Risk Management Framework

- 経済産業省

- 総務省

- 個人情報保護委員会

- 文化庁(AI と著作権に関する考え方の公開元)

- ISMAP ポータル

- Microsoft Trust Center

- OpenAI Trust Portal

コメント