本稿はシリーズ「生成AI業務利用の組み立て方」全3回の最終回です。第1回(NIST AI RMF と AI事業者ガイドラインで生成AI業務利用の枠組みを理解する)で公的フレームワークの骨格を、第2回(Samsung・JPMorgan・Amazon の生成AI事故から構造的落とし穴を読み解く)で他社事例の構造的問題を整理しました。本稿ではその両方を踏まえ、試行から成熟運用までの段階的ロードマップを4つのフェーズで提示します。

なぜ「段階的」に進めるのか

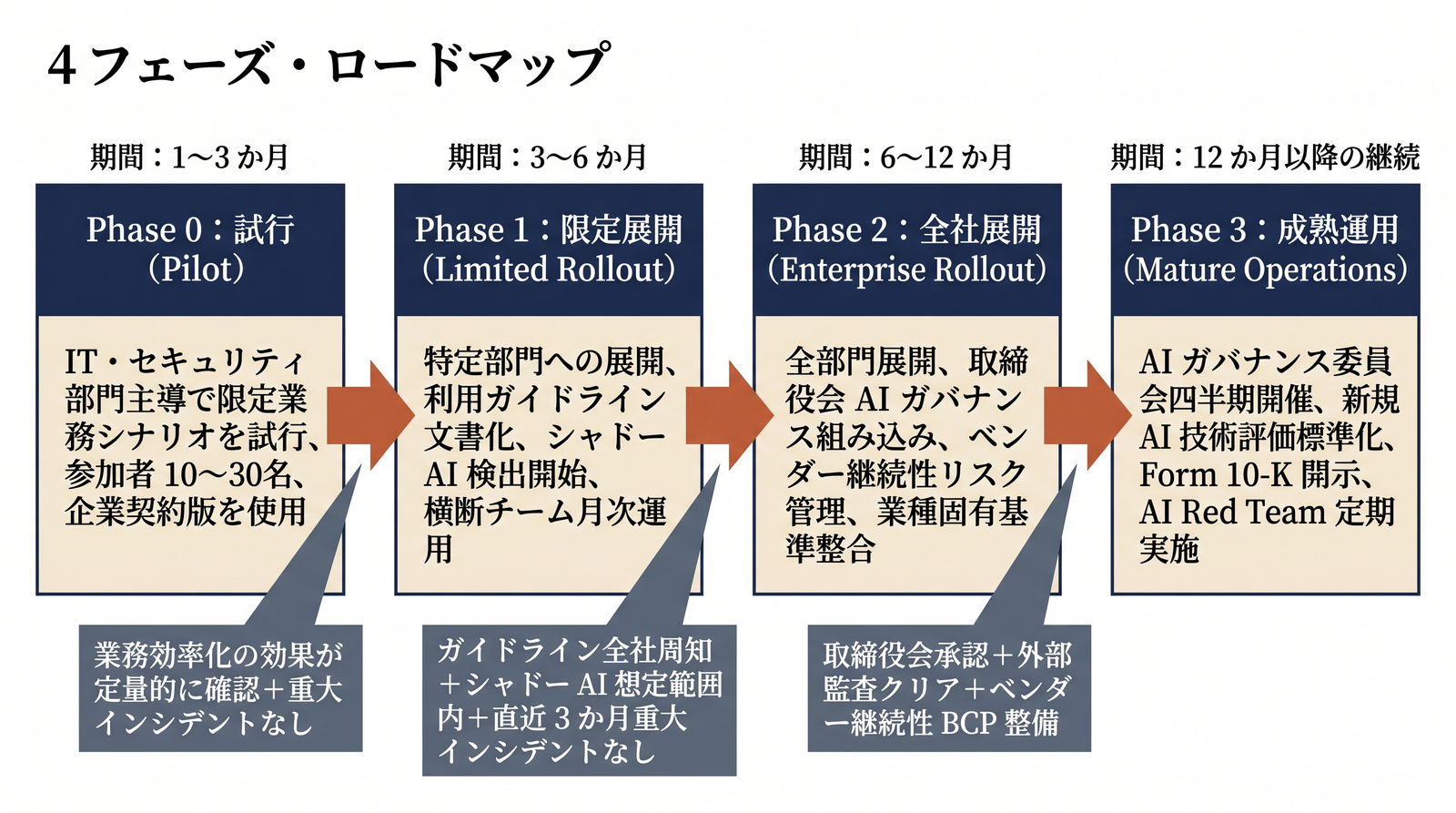

生成AIの業務利用は「導入か非導入か」の二択ではありません。Phase 0(試行)から Phase 3(成熟運用)まで、組織として段階的に成熟していくのが現実的なアプローチです。各フェーズで整備すべき項目と、次のフェーズに進む前のゲート条件を明確にすることで、Samsung 型の「個人判断による拡散」も、JPMorgan 型の「禁止だけで現場が回らない」状態も避けられます。

NIST AI RMF が示す「組織の AI 成熟度1評価」の考え方を業務利用視点に落とし込み、CISO・情シス・経営層が共有できるロードマップを以下に整理します。

なお一部の高リスク業務(医療診療記録の処理・裁判書類の作成・原子力等の安全クリティカル分野)では、Phase 3 段階でも生成AIの単独利用が適切でないケースがあります。本ロードマップは「業務利用が原則として許容される範囲」を前提とした整理です。

Phase 0:試行(Pilot)

目的: 組織として生成AIの可能性とリスクを把握する。本格展開の前提条件を見極める。

期間目安: 1〜3 か月。

主な活動:

- IT・セキュリティ部門主導で限定された業務シナリオ(社内文書の要約・コーディング補助等)を選定

- 試行参加者を10〜30名程度に限定し、参加同意書とアクノレッジメントを取得

- 試行ツールは企業契約版(ChatGPT Enterprise・Microsoft 365 Copilot 等)を選定し、無償プランは原則使わない

- 試行期間中の入力データ・出力結果・利用頻度をログとして記録

整備すべき5判断軸の状態(Part 1 で定義した「データ=扱えるデータ分類/権限=アクセス管理/出力=成果物品質管理/監査=ログ保管/教育=研修体制」の5軸):

- データ判断軸: 試行で扱えるデータ分類を「公開情報のみ」に限定

- 権限判断軸: 試行参加者全員に SSO・MFA 必須化

- 出力判断軸: 試行段階では「生成物を業務成果物として外部に出さない」を原則化

- 監査判断軸: 試行期間中の利用ログを 100% 取得・保管

- 教育判断軸: 試行参加者に 1 時間程度の事前研修を実施

Phase 0 → Phase 1 のゲート条件: 試行参加者から「業務効率化の効果が定量的に確認できた(例: 文書要約作業の所要時間が30分→5分、月次の作業時間削減が1人あたり10時間以上)」「重大なインシデント・規制違反が発生しなかった」の 2 点が報告されること。経営層への試行結果報告を経て次フェーズに進みます。

Phase 1:限定展開(Limited Rollout)

目的: 部門単位で生成AIを業務に組み込み、組織横断の運用ルールを整備する。

期間目安: 3〜6 か月。

主な活動:

- 特定部門(例: マーケティング部、エンジニアリング部)への展開を許可

- 生成AI利用ガイドライン(A4 1〜2ページ)を文書化し、全社向けに公開

- 利用許可ツールと禁止ツールを明示(許可リスト方式)

- シャドー AI 検出を SWG・CASB 等で開始(シャドーAI検出と統制設計を参照)

- CISO・情シス・法務・知財・人事を含む横断チームで論点整理を月次実施。人事・労組との事前協議(利用ログによる従業員監視の適法性確認を含む)も Phase 1 のうちに済ませる

整備すべき5判断軸の状態:

- データ判断軸: 「公開情報」「社内限」「機密」の 3 分類とツール対応関係を文書化

- 権限判断軸: 全 AI ツールで SSO・MFA 必須化、退職者アカウントの 30 日以内失効を運用

- 出力判断軸: ハイリスク用途(法的文書・財務報告・顧客向け資料等)で人間レビュー必須化

- 監査判断軸: 利用ログを 90 日以上保管、月 1 回以上の定期レビュー実施(中小規模では Excel/Spreadsheet ベースから出発しても可)

- 教育判断軸: 利用者全員に研修を実施、アクノレッジメント電子記録を保管

Phase 1 → Phase 2 のゲート条件: ①ガイドラインの全社周知が完了している ②シャドー AI 利用が想定範囲内に収まっている(例: 未承認 AI ツールへのアクセス試行が月 10 件以内、または全 AI トラフィックの 5% 以内など、組織規模に応じて事前に閾値設定) ③過去 3 か月間の利用ログレビューで重大インシデントなし、の 3 点。

Phase 2:全社展開(Enterprise Rollout)

目的: 全部門で生成AIを業務利用できる状態とし、コンプライアンス・監査要件を満たす運用に成熟させる。

期間目安: 6〜12 か月。

主な活動:

- 全部門への展開を許可、利用希望者は研修受講後に SSO 経由でアクセス可能化

- 取締役会レベルでのサイバーリスク監視体制にAI ガバナンスを組み込む(米国上場企業は SEC Form 10-K Item 106 でサイバーガバナンス開示が義務づけられており、AI 関連リスクも同枠で開示する企業が増加)

- ベンダー継続性リスクを Manage 機能の一部として管理(仕様変更・サービス終了・価格高騰への代替計画)

- 業種固有基準との整合確認(金融: FISC・SEC /公共: ISMAP /グローバル: EU AI Act 域外適用)

- AI 関連 D&O 保険または Cyber CISO Coverage2 の検討(米国上場企業を中心に CISO 個人責任リスクが顕在化、SolarWinds 事案の影響)

整備すべき5判断軸の状態:

- データ判断軸: 機密データを扱える AI ツールを書面で限定列挙、四半期に 1 回以上見直し

- 権限判断軸: 部門別の権限分離、特権 ID の定期レビュー

- 出力判断軸: 外部公開する生成物の類似性チェック・人間レビューを業務手順書で必須化

- 監査判断軸: 大規模組織は SIEM への AI 監査ログ集約、四半期ごとの異常検知レビュー

- 教育判断軸: 年 1 回の全社研修+部門別の追加研修

Phase 2 → Phase 3 のゲート条件: ①取締役会で AI ガバナンス体制が承認されている ②外部監査(SOC 2 や ISMS 等)で AI 利用統制が指摘事項なしで通過 ③ベンダー継続性 BCP が整備されている、の 3 点。

Phase 3:成熟運用(Mature Operations)

目的: 組織の AI 利用を競争優位の源泉として継続的に高度化する。規制改定・技術進化への適応を恒常運用化する。

期間目安: 12 か月以降の継続運用。

主な活動:

- AI ガバナンス委員会(経営層・CISO・法務・事業部門)を設置し四半期開催

- 新規 AI 技術(自律エージェント・カスタム LLM・社内 RAG3 基盤等)の評価プロセスを標準化

- Form 10-K Item 106 等の年次開示書類でガバナンス体制を対外公表(米国上場企業)

- AI Red Team4(攻撃側視点での AI システム評価)を定期実施

- AI 事業者ガイドライン・NIST AI RMF 等の更新を継続フォロー、社内ポリシーへ反映

整備すべき5判断軸の状態:

- 全 5 軸が「整備済」かつ継続改善サイクルが機能している

- 監査判断軸では AI 関連インシデントの傾向分析と先行指標化が進んでいる

- 教育判断軸では役職別・職種別の研修体系が定着している

Phase 3 で検討すべき次の論点:

- 自律 AI エージェント(Agentic AI)の業務組み込み

- AI モデルのファインチューニング・社内データ学習の安全性検証

- 生成AI出力の品質保証フレームワークの社内開発

4フェーズ全体を貫く 3 原則

各フェーズに共通して守るべき原則を整理します。

- 原則1:禁止と提供をセットで設計する(Part 2 JPMorgan 事例の教訓)— 「使ってはいけない」だけでは現場は回らず、シャドー利用を生みます。各フェーズで「禁止対象」と「許可される代替手段」を必ずペアで提示します。

- 原則2:ガイドラインは完成度より速度を優先する(Part 2 Samsung 事例の教訓)— 完璧なポリシーを 6 か月かけて作るより、A4 1 枚のドラフトを 1 週間で配布する方が「個人判断による拡散」を抑えられます。完成度は運用しながら高めます。

- 原則3:横断チームで論点整理する(Part 2 Amazon 事例の教訓)— 機密情報・規制対応・著作権・人事リスクは異なる部門の論点です。CISO・情シス単独では取りこぼします。法務・知財・コンプライアンス・人事を含む横断チームを各フェーズで維持します。

業種別のフェーズ進度

業種ごとに各フェーズで重点を置くべき要素が異なります。本稿では金融・製造・公共を例示しますが、ヘルスケア(HIPAA・医療機器規制)・小売(PCI DSS)・教育機関(個人情報・著作権の特殊性)等については各業界監督当局のガイダンスを併せて参照してください。

- 金融: Phase 1 で FISC 安全対策基準と金融庁監督指針との整合確認を最優先。Phase 2 では SEC・FINRA 等海外規制対応も視野に。

- 製造: Phase 0 から OT 環境(生産現場)と IT 環境の境界線を明示し、設計図面・特許情報の入力禁止を徹底。Phase 2 で外部公開生成物の著作権チェックを業務手順化。

- 公共・自治体: Phase 0 段階から ISMAP 登録サービスへの限定を厳守。Phase 1 以降、住民情報の取り扱いに関する特別ルールを整備。

実装事例:3社のフェーズ進度

以下は公開情報からの紹介です。各社の文脈・前提が異なるため、推奨ではなく参照点として整理しています。

- Samsung(製造): Phase 0 を経ずに従業員の個人判断で拡散 → 一時禁止 → 社内専用 LLM 開発という Phase 2 相当への急速な移行。Phase 0 を飛ばした結果、組織的学習機会を失った事例として参照されます。出典

- JPMorgan Chase(金融): Phase 0 段階で利用制限を判断し、Phase 2 で社内 LLM Suite を提供する段階的拡張の典型例。規制業種における「禁止 → 提供」モデルとして参照されます。出典

- Microsoft(テクノロジー): 自社が AI 提供事業者として、社内利用と顧客向けプロダクト開発を並行して Phase 3 段階で運用。Trust Center で透明性を継続開示する成熟運用の参照点。出典

一枚要約

- 何が起きているか: 生成AIの業務利用を「導入か非導入か」の二択で考える組織は、Samsung 型の急速な失敗か JPMorgan 型のシャドー利用に直面します。段階的成熟の視点でロードマップを組むことが現実的な解です。

- 自社への影響: 4 フェーズ(試行 → 限定展開 → 全社展開 → 成熟運用)の各段階で整備すべき項目が異なり、ゲート条件を明確化することで「段階を飛ばす失敗」を避けられます。

- 打つべき手: まず自社が今どのフェーズにいるかを 5 判断軸(データ・権限・出力・監査・教育)で診断し、次のゲート条件を満たすための整備計画を四半期単位で立てることが現実的な第一歩となります。

今日着手できる3アクション

- 自社の現在フェーズを診断する: 本稿の Phase 0 〜 Phase 3 の活動内容と整備状態を照らし合わせ、自社が今どのフェーズにいるかを A4 一枚に整理します。「部分的にしか整備されていない軸」がどこかを特定し、次のゲート条件を満たすための優先課題を明確化します。

- 横断チームの第 1 回会議をスケジュールする: CISO・情シス・法務・知財・人事の代表者を集めた月次の横断会議を設定します。Phase 1 以降で必須となる組織体制を、次のフェーズ移行前に作ります。第 1 回は「自社の現在フェーズと次フェーズへの課題」を議題とします。

- 次フェーズの「禁止 + 提供」ペアを設計する: 現在のフェーズで禁止している外部 AI ツールと、次フェーズで提供する代替手段の対応表を作成します。ChatGPT Enterprise・Microsoft 365 Copilot・Google Workspace 向け Gemini 等の企業契約版を比較検討します。比較軸の例: データ残留地域(国内・EU・米国)、SOC 2 Type II 取得有無、DLP 機能の有無、ISMAP 登録状況。調達計画に組み込みます。

AI×セキュリティの観点

段階的ロードマップの設計は、攻撃者の高度化に対する組織的耐性を作る取り組みでもあります。Phase 0 で限定的に始めた組織は、攻撃者がプロンプトインジェクション・データポイズニング等の AI 固有攻撃を試行しても影響範囲を抑えられます。一方、ガイドライン不在のまま全社展開した組織は、Samsung 事例のような機密流出だけでなく、AI 経由の侵入も受けやすくなります。NIST AI RMF の Manage 機能と、組織の AI 成熟度を上げる継続改善サイクルが、攻撃側の自動化への防御線として機能します。EU AI Act が要求する「人間による監督」の原則も、本稿の Phase 1 以降で構築する組織体制があってこそ実装可能となります。

用語ミニ解説

- AI 成熟度(AI Maturity) — 組織の AI 利用が「試行段階か成熟運用段階か」を評価する考え方。NIST AI RMF が示すライフサイクル管理と組み合わせて、段階的な改善計画の指標として用いられる。 ↩

- Cyber CISO Coverage — CISO 個人をサイバー関連訴訟の弁護費用・和解金から保護する保険プロダクト。SolarWinds 事案以降、米国を中心に企業契約が拡大している。 ↩

- RAG(Retrieval-Augmented Generation) — 社内データベース等を生成AIの検索ソースとして組み合わせる手法。社内情報を扱う業務利用で、外部 LLM への機密データ送信を回避する手段として活用される。 ↩

- AI Red Team — 攻撃者視点で AI システムの脆弱性を評価する専門チーム。プロンプトインジェクション・データポイズニング・モデル抽出等の AI 固有攻撃手法を用いる。 ↩

- エージェンティック AI(Agentic AI) — 単一の質問応答ではなく、複数ステップの自律的タスク実行を行う AI。Phase 3 段階で本格的な業務組み込みが検討される技術カテゴリ。 ↩

次に読むべきトピック

- 本シリーズ Part 1 「NIST AI RMF と AI事業者ガイドラインで生成AI業務利用の枠組みを理解する」

- 本シリーズ Part 2 「Samsung・JPMorgan・Amazon の生成AI事故から構造的落とし穴を読み解く」 — 失敗事例から3つの構造的落とし穴を抽出

- 関連記事: シャドーAI検出と統制設計 — Phase 1 で必要なシャドー AI 検出の具体手段

- 関連記事: AI規制の日米欧比較 — Phase 2 で対応する規制マッピング

コメント